【NCDA】手把手教你用AI玩转图像

时间:2025-07-17 | 作者: | 阅读:0未来设计师·全国高校数字艺术设计大赛始于2012年,每年一届,已入选中国高等教育学会发布的《全国普通高校学科竞赛排行榜》和《全国普通高校教师教学竞赛项目》,是高校教育教学改革和创新人才培养的重要竞赛项目之一。

第十届未来设计师·全国高校数字艺术设计大赛

未来设计师·全国高校数字艺术设计大赛始于2012年,每年一届,已入选中国高等教育学会发布的《全国普通高校学科竞赛排行榜》和《全国普通高校教师教学竞赛项目》,是高校教育教学改革和创新人才培养的重要竞赛项目之一。

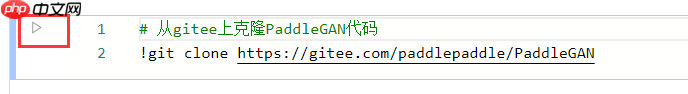

全文中遇到代码的地方,鼠标移动到代码框

点击左侧的运行即可

安装环境

下面代码运行时间大概需要?8?秒左右,请耐心等候

In [?]!pip install paddlehub --upgrade登录后复制

图像风格迁移

人工智能模型通过学习某一类图像(比如宫崎骏的所有漫画作品)后,再输入一张新的图片,模型就能根据之前学习到的参数对输入图片进行重新绘制,生成训练数据集对应的风格。PaddleHub目前已封装了三个不同风格漫画的模型,分别是宫崎骏风格、今敏风格和新海诚风格。

宫崎骏风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。output_dir: 输出文件夹,即生成图片保存的路径。其余参数保持不变即可。

下面代码运行时间大概需要?1?分钟左右,请耐心等候

In [2]import paddlehub as hubimport cv2from displayimg import imshow%matplotlib inlineimg = ”./work/fengge.jpg“ # <- 这里替换成原图的路径model = hub.Module(name=”animegan_v2_hayao_99“)result = model.style_transfer( images = [cv2.imread(img)], output_dir = './output/gongqijun', # <- 运行完成后在左侧栏的output文件夹下面的gongqijun文件夹可以找得到生成后的图像文件 visualization = True )imshow(img, result[0])登录后复制

[2022-03-29 22:50:10,223] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the objectW0329 22:50:10.226275 2454 analysis_predictor.cc:1350] Deprecated. Please use CreatePredictor instead.登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

今敏风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。output_dir: 输出文件夹,即生成图片保存的路径。其余参数保持不变即可。

下面代码运行时间大概需要?1?分钟左右,请耐心等候

In [3]import paddlehub as hubimport cv2from displayimg import imshow%matplotlib inlineimg = './work/fengge.jpg' # <- 这里替换成原图的路径model = hub.Module(name=”animegan_v2_paprika_98“)result = model.style_transfer( images=[cv2.imread(img)], output_dir = './output/jinmin', # <- 运行完成后在左侧栏的output文件夹下面的jinmin文件夹可以找得到生成后的图像文件 visualization = True )imshow(img, result[0])登录后复制

[2022-03-29 22:51:07,384] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

新海诚风格

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。output_dir: 输出文件夹,即生成图片保存的路径。其余参数保持不变即可。

下面代码运行时间大概需要?1?分钟左右,请耐心等候

In [4]import paddlehub as hubimport cv2from displayimg import imshow%matplotlib inlineimg = './work/fengge.jpg' # <- 这里替换成原图的路径model = hub.Module(name=”animegan_v2_shinkai_53“)result = model.style_transfer( images=[cv2.imread(img)], output_dir = './output/xinhaicheng', # <- 运行完成后在左侧栏的output文件夹下面的xinhaicheng文件夹可以找得到生成后的图像文件 visualization = True )imshow(img, result[0])登录后复制

[2022-03-29 22:52:03,873] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

图片转油画

Paint Transformer是百度、南京大学提出的首个基于前馈笔触预测来进行快速油画渲染的算法,可以快速将一张图片变成一幅充满质感的油画!飞桨版本由飞桨开发者技术专家AP-Kai转换和封装。

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。其余参数保持不变即可。

下面代码运行时间大概需要?12?秒左右,请耐心等候

In [2]%cd paintmaster/import cv2from PIL import Imagefrom displayimg import imshowfrom inference.inference import main as infer_main%matplotlib inlineimg = ”/home/aistudio/work/fengge.jpg“ # <- 这里替换成原图的路径result = infer_main(img, ”inference/paint_best.pdparams“, '../output', resize_h=1024, resize_w=1024)imshow(img, result)%cd /home/aistudio登录后复制

/home/aistudio/paintmaster登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

/home/aistudio登录后复制

黑白图片上色

老照片/黑白照记录着曾经的岁月,承载着美好的回忆与厚重的历史。但由于年代久远,旧的图像素材往往存在模糊、缺色等问题。我们可以通过人工智能模型,让老照片重现往日光彩。

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。output_path: 输出文件夹,即生成图片保存的路径。其余参数保持不变即可。

下面代码运行时间大概需要?1?分钟左右,请耐心等候

In [6]import paddlehub as hubfrom displayimg import imshow%matplotlib inlineimg = 'work/heibai.jpg' # <- 这里替换成原图的路径model = hub.Module(name='deoldify', output_path=”./output/“) # <- 运行完成后在左侧栏的output文件夹下面的DeOldify文件夹可以找得到生成后的图像文件result = model.predict(img)imshow(img, result[0])登录后复制

load pretrained checkpoint success登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

人像抠图

21世纪了,还在傻傻地用Photoshop的魔棒低效率抠图吗?试下下面这个神器吧,不仅能一步就把人像从复杂的背景中抠出来,还能顺便换个背景。

抠人像

参数说明

img: 输入图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。output_dir: 输出文件夹,即生成图片保存的路径。其余参数保持不变即可。

下面代码运行时间大概需要?15?秒左右,请耐心等候

In [7]import paddlehub as hubimport cv2from displayimg import imshow%matplotlib inlineimg = ”work/ren.jpg“ # <- 这里替换成原图的路径human_seg = hub.Module(name=”deeplabv3p_xception65_humanseg“)result = human_seg.segmentation( images = [cv2.imread(img)], output_dir = './output/humanseg', # <- 运行完成后在左侧栏的output文件夹下面的humanseg文件夹可以找得到生成后的图像文件 visualization = True)imshow(img, result[0]['save_path'], True)登录后复制

[2022-03-29 22:53:15,620] [ WARNING] - The _initialize method in HubModule will soon be deprecated, you can use the __init__() to handle the initialization of the object登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

换背景

参数说明

backgroundImg: 输入背景图片的路径,本地图片可以拖拽到左边的文件栏上传,然后右键该文件复制路径更换这个变量值。saveImg: 合成后图片保存的路径和文件名其余参数保持不变即可。

下面代码运行时间大概需要?1-3?秒左右

In [8]from PIL import Image from displayimg import imshow%matplotlib inlinebackgroundImg = ”work/beijing.jpg“ # <-背景图片路径saveImg = './output/background_replace_output.png' # <- 图片合成后的保存路径humanImg = result[0]['save_path']backgroundImg = Image.open(backgroundImg).convert('RGBA')humanImg = Image.open(humanImg).convert('RGBA')resultImg = Image.new(”RGBA“, backgroundImg.size)resultImg = Image.alpha_composite(resultImg, backgroundImg)resultImg = Image.alpha_composite(resultImg, humanImg)resultImg.save(saveImg)imshow(result[0]['save_path'], saveImg, True)登录后复制

<Figure size 840x700 with 2 Axes>登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制登录后复制

来源:https://www.php.cn/faq/1411296.html

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

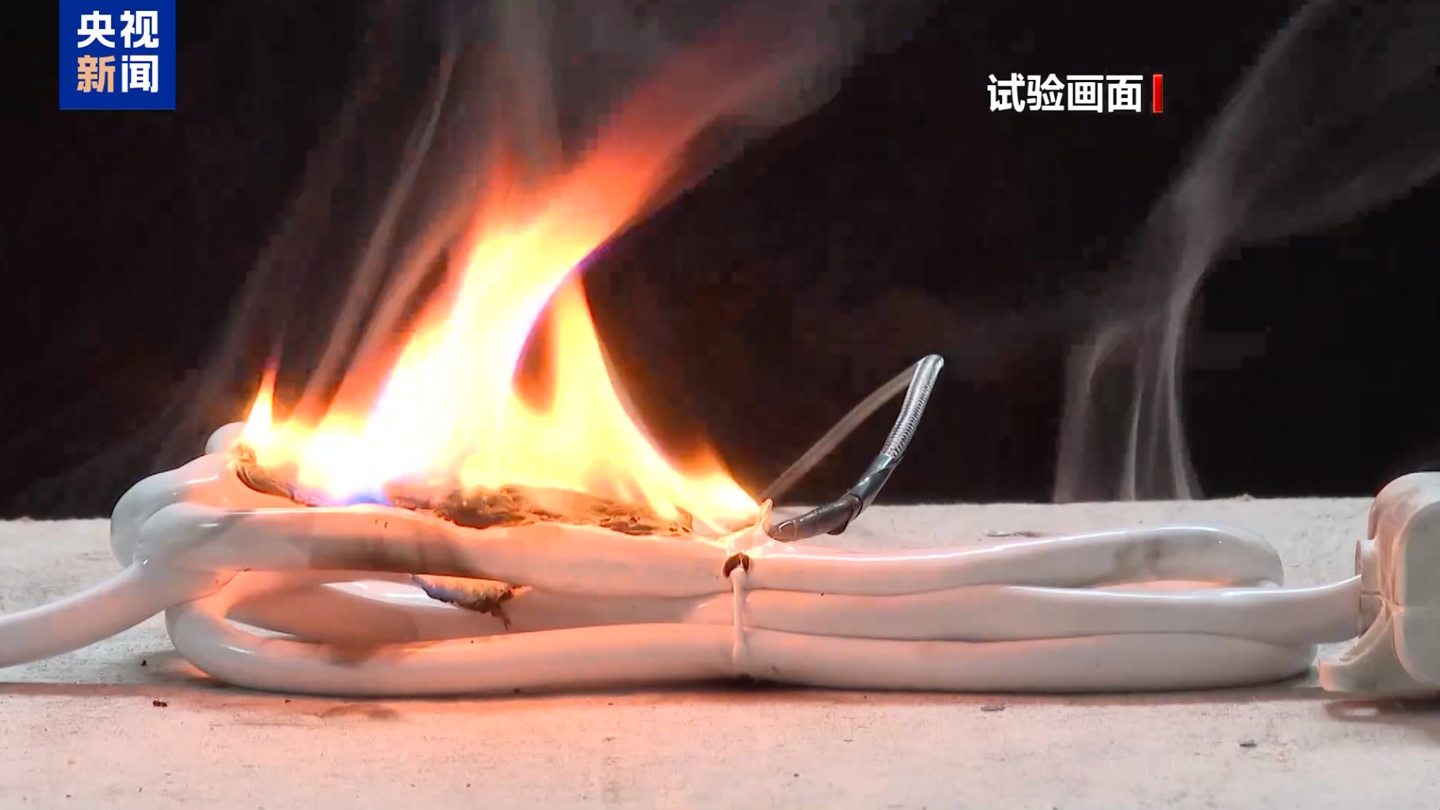

- 消防提醒:电线捆扎一团更危险,可能导致聚热升温甚至引发火灾

- 时间:2025-11-10

-

- 十一连冠!联想再获中国HPC TOP100年度数量份额第一

- 时间:2025-11-10

-

- 双11冬装消费热 过万中小鞋服商家抖音店播销售翻倍

- 时间:2025-11-10

-

- AI将减少你的工时 摩根大通CEO:未来发达国家每周可能只需上班3.5天

- 时间:2025-11-10

-

- 滴滴顺风车推出 AI 模型打击私下拼车,违规者最高面临封禁

- 时间:2025-11-10

-

- 炒作苹果人安卓人户晨风被全网封杀:专家痛批靠这种流量赚钱非蠢即坏

- 时间:2025-11-10

-

- 滴滴顺风车严打私下拼车:AI技术都用上了 无所遁形

- 时间:2025-11-10

-

- 国际认可再加码!追觅FP10空气净化器斩获2026 CES创新奖

- 时间:2025-11-09

大家都在玩

大家都在看

更多-

- 辉烬武魂搭配推荐

- 时间:2025-11-09

-

- 辉烬知世配队攻略

- 时间:2025-11-09

-

- 二重螺旋耶尔与奥利弗谁厉害

- 时间:2025-11-09

-

- 有魅力比较帅的王者荣耀名字

- 时间:2025-11-09

-

- 二重螺旋丽蓓卡技能解析

- 时间:2025-11-09

-

- “原来心累可以写得这么刀”

- 时间:2025-11-09

-

- 二重螺旋梦魇残响

- 时间:2025-11-09

-

- 迫击炮游戏推荐2025

- 时间:2025-11-09