Monodepth2-»щУЪЧФја¶ҪС§П°өДөҘДҝЙо¶И№АјЖДЈРН

КұјдЈә2025-07-22 | ЧчХЯЈә | ФД¶БЈә0Monodepth2КЗICCV2019·ўұнөДЧФја¶ҪөҘДҝЙо¶И№АјЖ·Ҫ·ЁЈ¬ОӘMonodepthЙэј¶°жЎЈЖдҪбәПЛ«ДҝНјПсУлөҘДҝРтБРЧФја¶Ҫ·Ҫ·ЁЈ¬ә¬Йо¶ИФӨІвәНО»ЧЛұд»»ФӨІвНшВзЈ¬ТэИл¶аЦЦУЕ»ҜІЯВФ»сөұКұSOTAЎЈұҫОДҪйЙЬЖдёҙПЦ№эіМЈ¬УГKITTIКэҫЭјҜЈ¬ҫӯ640x192СөБ·ј°1024x320ОўөчЈ¬abs_relҙп0.104Ј¬»№ә¬КэҫЭјҜЎўҙъВлҪб№№өИРЕПўЎЈ

1. јтҪй

Monodepth2КЗНЁ№эЧФја¶ҪС§П°ҪшРРөҘДҝЙо¶И№АјЖөДТ»ЦЦ·Ҫ·ЁЈ¬·ўұнУЪICCV2019Ј¬КЗ·ўұнУЪCVPR2017өДMonodepthөДЙэј¶°жЎЈMonodepth»щУЪұк¶Ё№эөДЛ«ДҝНјПсЈ¬НЁ№эФӨІвЦРјдұдБҝdisparity(КУІо)Аҙ¶ФТ»ІаНјПсҪшРРұд»»ЦШ№№БнТ»ІаНјПсЈ¬ІўТФЦШ№№ЛрК§ҪшРРСөБ·,УР№ШMonodepthөДёҙПЦҝЙТФІОҝјОТөДБнТ»ёцПоДҝЎЈ

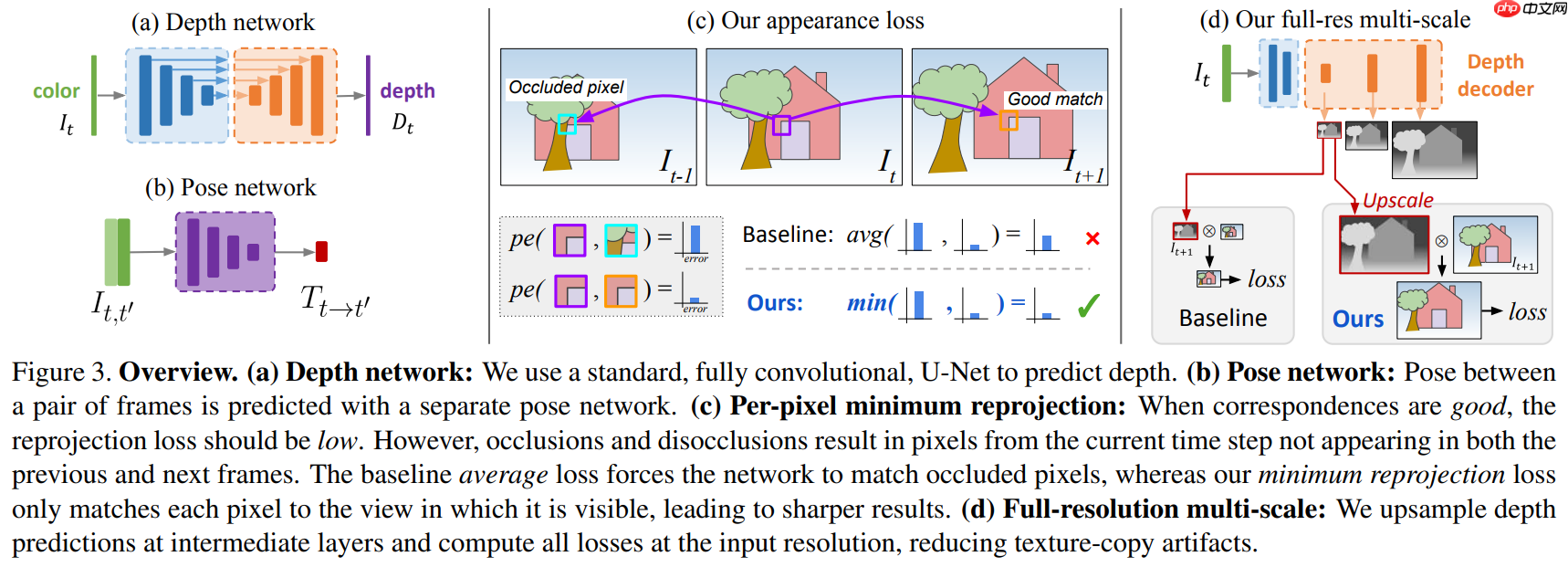

Monodepth2ФЪҙЛ»щҙЎЙПјУИлБЛұИҪПБчРРөДөҘДҝРтБРЧФја¶Ҫ·Ҫ·ЁЈ¬јҙНЁ№эФӨІвөҘДҝПаБЪЦЎЦ®јдөДО»ЧЛұд»»УлЙо¶ИНјАҙЦШ№№ПаБЪЦЎЎЈMonodepth2Ҫ«БҪЦЦСөБ··ҪКҪНіТ»өҪБЛ»щУЪТ»ёцО»ЧЛұд»»өДҝтјЬПВЈ¬ЙПНјОӘЖдөДҝтјЬҪб№№ј°Хл¶ФІҝ·ЦОКМвөДёДҪшЎЈҝтјЬЦР°ьә¬БҪёцНшВзЈ¬Т»ёцКЗЙо¶ИФӨІвНшВзЈ¬ёш¶ЁТ»ХЕНјЖ¬Ј¬ФӨІвЙо¶ИНјЈ¬ХвёцТІКЗОТГЗЧоәуПлөГөҪөДНшВзЈ»БнТ»ёцКЗО»ЧЛұд»»ФӨІвНшВзЈ¬ёш¶ЁТ»¶ФНјЖ¬Ј¬ФӨІвБҪХЯЦ®јдөДО»ЧЛұд»»Ј¬Т»°гёш¶ЁөДКЗПаБЪөДЗ°әуБҪЦЎЈ¬ҙЛНшВзУГУЪёЁЦъСөБ·Ј»СөБ·КұСЎИЎЧуПа»ъДіТ»ЦЎЧчОӘ»щЧјЈ¬јЖЛгЙо¶ИНјЈ¬ЖдЗ°әуБҪЦЎј°УТПа»ъН¬ЦЎНјПсҪшРРЧчОӘІОҝјЈ¬јЖЛгО»ЧЛұд»»ЈЁУТПа»ъО»ЧЛұд»»ОӘіЈКэЈ¬І»РиТӘҪшРРФӨІвЈ©Ј¬АыУГФӨІвөГөҪөДЙо¶ИНјҪ«»щЧјНјПсұд»»ОӘөгФЖЎўҪшРРО»ЧЛұд»»ЎўФЩЦШН¶У°өГөҪЦШ№№НјПсјЖЛгЦШ№№ЛрК§ЎЈ

іэҙЛЦ®НвЈ¬Monodepth2ТэИлБЛТ»Р©РВtrickАҙМбЙэРФДЬЈә

- К№УГresnetФӨСөБ·ДЈРНЈ¬ј«ОӘПФЦшөШМбЙэРФДЬЎЈ

- ¶ФУЪГҝёцПсЛШөгЈ¬јЖЛгУЙІ»Н¬КУҪЗҪшРРЦШ№№ЛщІъЙъОуІоөДЧоРЎЦөЧчОӘlossЈ¬К№өГloss¶ФУЪКЬХЪөІөДОпМеёьјУВі°фЎЈ

- Ҫ«І»Н¬іЯ¶ИөДКУІоНјresizeөҪФӯКјіЯҙз¶ФФӯНјҪшРРЈ¬ПФЦшҪөөНБЛЙо¶ИНјЦРІ»әПАнөДОЖАнМШРФЎЈ

- ЧФ¶Ҝmaskөф»б¶ҜөДОпМеЈ¬К№өГКХөҪја¶ҪөДПсЛШ¶јВъЧгҫІМ¬іЎҫ°өДјЩЙиЎЈ

ЧЫәПХвР©trickЈ¬Monodepth2өГөҪБЛөұКұЧФја¶ҪЙо¶И№АјЖөДSOTAР§№ыЈ¬ө«ИФИ»Улја¶Ҫ·Ҫ·ЁУРЧЕТ»¶ЁІоҫаЎЈ

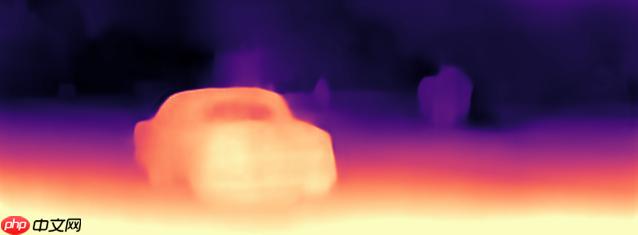

ТФПВОӘұҫПоДҝДЈРНФЪKITTIІвКФНјПсЙПөДФӨІвҪб№ыЈә

ВЫОД:?Digging Into Self-Supervised Monocular Depth Estimation

ІОҝјrepo:?monodepth2

2. КэҫЭјҜ

KITTIКЗТ»ёцЧФ¶ҜјЭК»БмУтіЈУГөДКэҫЭјҜЈ¬ЖдУЙЕдЦГБЛҙ«ёРЖчөДЖыіөУЪөВ№ъҝЁ¶ыЛ№Ві¶тІЙјҜЈ¬КэҫЭЦР°ьә¬БЛЛ«ДҝІКЙ«НјПсЎўЙо¶ИНјПсЎўАЧҙпөгФЖөИҙ«ёРКэҫЭЈ¬ІўМṩДҝұкјмІвЎўКөАэ·ЦёоөИіЈјыCVИООсөДұкЗ©ЎЈұҫПоДҝК№УГAI StudioЙПөДKITTIС№ЛхКэҫЭјҜЈ¬И«ІҝКэҫЭҝЙҙУҙЛҙҰПВФШЎЈФЪСөБ·№эіМЦРЦ»РиТӘЛ«ДҝНјПсЈ¬ЛщТФЦ»ҪвС№jpg_images.tar.*јҙҝЙЎЈ

KITTIКэҫЭјҜҙжФЪБҪЦЦ»®·ЦЈ¬Т»ЦЦКЗ№Щ·ҪұкЧј»®·ЦЈ¬іЖОӘKITTI»®·ЦЈ¬БнТ»ЦЦКЗEigen et. al.МбіцөДEigen»®·Ц·ҪКҪЎЈБмУтДЪёьіЈУГEigen»®·ЦҪшРРЖА№АЎЈУЙУЪФЪЖА№АКұРиТӘөгФЖКэҫЭАҙјЖЛгЙо¶ИНјөДgroundtruthЈ¬ҪвС№И«ІҝөгФЖКэҫЭјҜХјУГУІЕМҝХјд№эҙуЈ¬ОТГЗ¶ФEigen»®·ЦөДІвКФјҜҪшРРБЛөҘ¶АөДҙт°ьЈ¬ҝЙФЪҙЛҙҰПВФШЎЈ

3. ёҙПЦҫ«¶И

КЧПИСөБ·КдИл·ЦұжВКОӘ640x192өДДЈРНЈәјУФШresnet18ФӨСөБ·ДЈРНЈ¬batch size 12Ј¬epoch 20Ј¬УЕ»ҜЖчAdamЈ¬іхКјС§П°ВК1e-4Ј¬15ёцepochәујхРЎОӘ1e-5ЎЈФӯОДәНІЦҝвІўГ»УРМṩЧоУЕДЈРНөДСЎФс·Ҫ·ЁЈ¬ОТГЗұЈҙжСйЦӨјҜlossЧоөНөДДЈРНОӘЧоУЕДЈРНЎЈҙЛКұөГөҪөДЧоУЕДЈРНabs_relОӘ0.109Ј¬ОҙҙпөҪСйКХҫ«¶ИЎЈ

Ц®әуҪ«ТФ640x192ОӘКдИл·ЦұжВКөДЧоУЕДЈРНФЪ1024x320өДКдИл·ЦұжВКЙПҪшРРfinetuneЈ¬batch size 4Ј¬epoch 2Ј¬УЕ»ҜЖчAdamЈ¬С§П°ВК5e-5ЎЈөГөҪөДДЈРНabs_relОӘ0.104Ј¬ҙпөҪСйКХұкЧјЎЈ

ЧўТвЈәОӘБЛ№М¶ЁКэҫЭФцЗҝөДЛж»ъРФЈ¬ПоДҝЦРК№УГsetup_seed¶ФDataloaderЦРөДЛщУРworkerҪшРРБЛіхКј»ҜЈ¬ХвҫНөјЦВБЛҪб№ыКЗәНworkerөДКэБҝПа№ШөДЈ¬ПлТӘНкИ«ёҙПЦПоДҝЦРөДҪб№ыЈ¬өЪТ»Іҝ·ЦСөБ·өДnum_workers=16Ј¬өЪ¶юІҝ·ЦСөБ·өДnum_workers=4ЎЈ

СөБ·ИХЦҫБҙҪУЈә640x192 train log,?1024x320 finetune log,?640x192 test log,?1024x320 test log

ИЁЦШОДјюБҙҪУЈәpytorch resent18 pretrained weight,?our best 640x192 weights,?our best 1024x320 weights

4. ҝмЛЩҝӘКј

Step 1ЈәЧјұёКэҫЭ

In [1]!cat ~/data/data15348/jpg_images.tar.* | tar -x -C ~/data/!rm ~/data/data15348/jpg_images.tar.*өЗВјәуёҙЦЖIn [2]

!tar -xzf ~/data/data124009/eigen_test.tgz -C ~/dataөЗВјәуёҙЦЖ

Step 2ЈәЕдЦГ»·ҫі

In [3]%cd /home/aistudio/work/monodepth2-paddle!pip install -r requirements.txtөЗВјәуёҙЦЖ

Step 3ЈәСөБ·

In [?]# train the model at resolution of 640 x 192 !python train.py --model_name mono+stereo_model_640x192 --frame_ids 0 -1 1 --use_stereo --data_path ~/data/kitti --log_dir logs --num_workers 4 --weights_init weights/resnet18-pytorchөЗВјәуёҙЦЖIn [7]

# finetune the best 640 x 192 model at resolution of 1024 x 320!python train.py --model_name mono+stereo_model_1024x320 --frame_ids 0 -1 1 --use_stereo --data_path ~/data/kitti --height 320 --width 1024 --load_weights_folder weights/best_640x192/ --log_dir logs --num_workers 4 --batch_size 4 --num_epochs 2 --learning_rate 5e-5өЗВјәуёҙЦЖIn [11]

!python evaluate_depth.py --load_weights_folder weights/best_1024x320/ --eval_stereo --data_path ~/data/eigen --num_workers 4өЗВјәуёҙЦЖIn [?]

!python demo.py --image_path assets/test_image.jpg --load_weights_folder weights/best_1024x320/өЗВјәуёҙЦЖ

5. ҙъВлҪб№№

©А©Ө©Ө assets # demoНјПс©А©Ө©Ө datasets # КэҫЭјҜ¶ЁТе©А©Ө©Ө logs # ИХЦҫОДјюјР©А©Ө©Ө network # НшВз¶ЁТе©А©Ө©Ө splits # КэҫЭјҜКэҫЭ»®·ЦОДјю©А©Ө©Ө weights # ҙж·ЕИЁЦШОДјю©А©Ө©Ө LICENSE©А©Ө©Ө README.md©А©Ө©Ө demo.py # өҘХЕНјПсЙо¶И№АјЖҪЕұҫ©А©Ө©Ө evalute_depth.py # ІвКФҪЕұҫ©А©Ө©Ө export_gt_depth.py # јЖЛгgroundtruth©А©Ө©Ө kitti_utils.py # УлKITTIКэҫЭјҜПа№ШөД№ҰДЬәҜКэ©А©Ө©Ө layers.py # »щҙЎДЈҝй¶ЁТе©А©Ө©Ө options.py # і¬ІОКэ¶ЁТе©А©Ө©Ө trainer.py # СөБ··ҪКҪ¶ЁТе©А©Ө©Ө train.py # СөБ·ИлҝЪҪЕұҫ©А©Ө©Ө requirements.txt # ТААө°ь©ё©Ө©Ө utils.py # №ҰДЬәҜКэөЗВјәуёҙЦЖ

6. ёҙПЦРДөГ

- paddle.grid_sampleөД·ҙПтҙ«ІҘҙжФЪBugЈ¬өұgrid.stop_gradient=FalseКұЈ¬x.stop_gradientұШРлОӘFalseЈ¬·сФт»бұЁҙнЈ¬ТСМбҪ»PaddlePaddle?issueЎЈ

- Paddle HubЦРөДResnetФӨСөБ·ІОКэУлPyTorch HubөДІ»Н¬Ј¬К№УГPaddleөДФӨСөБ·ІОКэФЪ640x192ЙПСөБ·ЧоәГЦ»ДЬҙпөҪ0.113Ј¬јУФШPyTorchөДФӨСөБ·ДЈРНҝЙҙпөҪ0.109ЎЈ

АҙФҙ:https://www.php.cn/faq/1421600.html

ГвФрЙщГчЈәОДЦРНјОДҫщАҙЧФНшВзЈ¬ИзУРЗЦИЁЗлБӘПөЙҫіэЈ¬РДФёУОП··ўІјҙЛОДҪцОӘҙ«өЭРЕПўЈ¬І»ҙъұнРДФёУОП·ИПН¬Жд№Ыөг»тЦӨКөЖдГиКцЎЈ

Па№ШОДХВ

ёь¶а-

- nef ёсКҪНјЖ¬ҪөФлҙҰАнУГКІГҙ№ӨҫЯ Р§№ыИзәО

- КұјдЈә2025-07-29

-

- УКПдіӨКұјдОҙөЗВјұ»ЧўПъБЛДЬ»ЦёҙВрЈҝ

- КұјдЈә2025-07-29

-

- OutlookКХјюПдУКјюІ»Н¬ІҪФхГҙ°мЈҝ

- КұјдЈә2025-07-29

-

- ОӘКІГҙҝН»§¶ЛКХУКјюЧЬКЗСУіЩЈҝ

- КұјдЈә2025-07-29

-

- Т»УўҙзФЪҙЕҙшҝн¶ИЦРКЗ¶аЙЩ АПКҪЙиұё№жёс

- КұјдЈә2025-07-29

-

- ҙуҝЁәНДкБдөД№ШПө І»Н¬ДкБд¶ОИИБҝРиЗу

- КұјдЈә2025-07-29

-

- jif ёсКҪКЗ gif өДұдМеВр ПЦФЪ»№іЈУГВр

- КұјдЈә2025-07-29

-

- hdr ёсКҪНјЖ¬ФЪПФКҫЖчЙПДЬНкИ«ПФКҫВр ЖХНЁПФКҫЖчУРҫЦПЮВр

- КұјдЈә2025-07-29

ҫ«СЎәПјҜ

ёь¶аҙујТ¶јФЪНж

ИИГЕ»°Мв

ҙујТ¶јФЪҝҙ

ёь¶а-

- ІФТнЈә»мгзР§УҰXКІГҙКұәтіц №«ІвЙППЯКұјдФӨёж

- КұјдЈә2025-11-23

-

- НшТЧlofterИзәОНЖ№г LOFTERҝӘЖфЧЁМвНЖЛН№ҰДЬ·Ҫ·Ё

- КұјдЈә2025-11-23

-

- 2025ұШНжөД»»Ч°РЎУОП·НЖјц

- КұјдЈә2025-11-23

-

- ҙ©ФҪ»рПЯКЦУОФхГҙМшЗҪ

- КұјдЈә2025-11-23

-

- lofterФхГҙ·ўЧчЖ· lofterұајӯТС·ўІјЧчЖ·ҪМіМ

- КұјдЈә2025-11-23

-

- 2025ёЯИЛЖш·ЙРРДЈДвУОП·НЖјц

- КұјдЈә2025-11-23

-

- Ў¶ёоІЭУўРЫЎ·Нж·Ё№ҘВФ іхМҪёоІЭУўРЫКАҪз

- КұјдЈә2025-11-23

-

- lofterИзәОёҙЦЖОДХВ LOFTERёҙЦЖОДХВөДБҙҪУҪМіМ

- КұјдЈә2025-11-23