NVIDIA要用上X3D堆叠设计!下代Feynman GPU将引入LPU

时间:2025-12-29 | 作者: | 阅读:012月29日消息,虽然NVIDIA目前在AI训练领域无可匹敌,但面对日益增长的即时推理需求,其正筹划一项足以改变行业格局的“秘密武器”。

据AGF透露,NVIDIA计划在2028年推出的Feynman(费曼)架构GPU中,整合来自Groq公司的LPU(语言处理单元),以大幅提升AI推理性能。

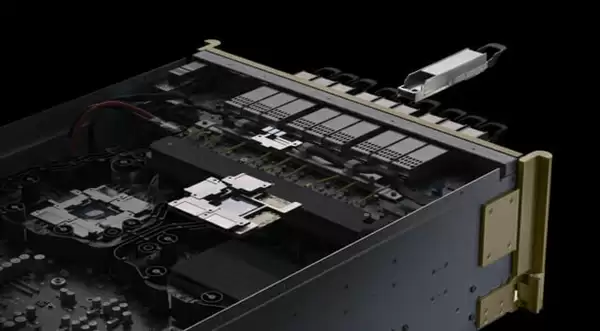

Feynman架构将接替Rubin架构,采用台积电最先进的A16(1.6nm)制程,为了突破半导体物理限制,NVIDIA计划利用台积电的SoIC混合键合技术,将专为推理加速设计的LPU单元直接堆叠在GPU之上。

这种设计类似于AMD的3D V-Cache技术,但NVIDIA堆叠的不是普通缓存,而是专为推理加速设计的LPU单元。

设计的核心逻辑在于解决SRAM的微缩困境,在1.6nm这种极致工艺下,直接在主芯片集成大量SRAM成本极高且占用空间。

通过堆叠技术,NVIDIA可以将运算核心留在主芯片,而将需要大量面积的SRAM独立成另一层芯片堆叠上去。

台积电的A16制程一大特色是支持背面供电技术,这项技术可以腾出芯片正面的空间,专供垂直信号连接,确保堆叠的LPU能以极低功耗进行高速数据交换。

结合LPU的“确定性”执行逻辑,未来的NVIDIA GPU在处理即时AI响应(如语音对话、实时翻译)时,速度将实现质的飞跃。

不过这也存在两大潜在挑战,分别是散热问题和CUDA兼容性难题,在运算密度极高的GPU 再加盖一层芯片,如何避免“热当机”是工程团队的头号难题。

同时LPU强调“确定性”执行顺序,需要精确的内存配置,而CUDA生态则是基于硬件抽象化设计的,要让这两者完美协同,需要顶级的软件优化。

来源:https://news.mydrivers.com/1/1095/1095424.htm

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- 挑战GPU独大格局!谷歌自研TPU冲刺3500万颗:成本比GPU低30%以上

- 时间:2026-06-08

-

- 富士康展示液冷版RTX Pro 6000服务器GPU

- 时间:2026-06-08

-

- GPU-Z查看显卡实时功耗及传感器监控设置方法

- 时间:2026-05-30

-

- HBM内存技术革新:分离式封装与光互联突破GPU性能瓶颈

- 时间:2026-05-25

-

- 革命性突破!HBM告别GPU贴身设计:分离封装+光互联打破内存墙

- 时间:2026-05-25

-

- 国产显卡LX 7G100游戏性能实测:18款游戏对比RTX 3060表现如何

- 时间:2026-05-23

-

- GPU-Z无法检测显卡体质解决方法

- 时间:2026-05-23

-

- GPU-Z检测显卡体质教程:如何查看与解读体质分数

- 时间:2026-05-22

精选合集

更多大家都在玩

热门话题

大家都在看

更多-

- 万神殿战略城市建造游戏《Theos: Cities of Myth》将于今年登陆PC平台

- 时间:2026-06-08

-

- 上帝模拟游戏《Ornelia》将以抢先体验的形式登陆PC平台

- 时间:2026-06-08

-

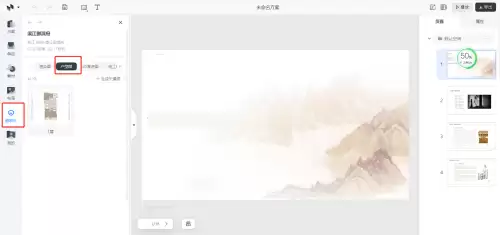

- 美间导入酷家乐户型图矢量文件详细教程

- 时间:2026-06-08

-

- 美间家居海报制作全攻略 快速上手技巧分享

- 时间:2026-06-08

-

- 日语配音秀App核心功能全面解析与使用指南

- 时间:2026-06-08

-

- 单人僵尸撤离类游戏《Pale Tide》将登陆PC平台

- 时间:2026-06-08

-

- 蚂蚁庄园今日答案最新6.9 6月9日庄园每日答题答案

- 时间:2026-06-08

-

- 美间智能排版软件使用教程与操作指南

- 时间:2026-06-08