OpenClaw Token消耗得太快怎么办?

时间:2026-03-10 | 作者:互联网 | 阅读:0OpenClaw Token消耗过快怎么办?

Token消耗过快是“龙虾大军”最普遍的心头痛。有用户反映重度使用下,1亿Token仅够撑一个月,成本约七千元;更有甚者因AI失控,一夜之间消耗数亿Token,收到数万元账单。不过别担心,通过优化设置和安装省钱技能,完全可以实现40%-95%的Token节省。以下是全网最全的省钱攻略。

一、根源诊断:为什么Token烧得这么快?

暴力读取全文件: 处理PDF、代码库时,直接完整内容喂给大模型,冗余信息浪费严重。

网页搜索返回冗余数据: 常规搜索返回HTML、广告等垃圾信息,模型需消耗Token解析筛选。

对话记忆无限制膨胀: 每次会话都加载完整历史记录,重复内容反复消耗Token。

无效循环与异常调用: 工具调用失败后无限制重试、死循环,短时间内烧光Token。

固定基础消耗: 即使一句“你好”,也需加载所有工具定义和引导文件,原版固定消耗约15,466 Token。

后台心跳机制: 即便闲置状态也在不停“烧钱”,持续触发端口调用。

二、6大神级省钱技能:安装即省40%-95%

1. QMD(必装首选,节省90%+):本地语义搜索引擎,采用三层混合检索机制,只将与指令相关的核心片段传给模型,彻底解决长记忆文件Token浪费问题。安装方法:在OpenClaw容器内执行bun install -g qmd,编辑配置文件添加memory相关配置,重启网关。实测每次查找从15,000 Token降至1,500 Token,长会话(100轮)消耗从50万Token降至6万Token。

2. exa-search(节省70%-90%):纯净网页搜索技能,过滤HTML标签、广告等冗余信息,仅返回纯文本。安装:npx clawhub@latest install exa-search。联网查询、热点搜集场景必备。

3. memory-optimizer(节省40%-60%):对话记忆自动压缩,夜间自动压缩SOUL.md等记忆文件,去除重复内容。需搭配本地模型使用。

4. prompt-guard(安全+省钱,节省70%):分层加载防御规则,过滤恶意请求和无关内容,避免AI被垃圾信息带偏、浪费Token。安装后在配置文件中启用即可。

5. clawsec(止损100%):安全熔断防无效调用,检测到异常调用时自动熔断,避免死循环消耗。

6. index1(节省80%):轻量级代码检索,建立代码索引,仅返回相关函数块而非完整文件,适用于代码开发场景。

三、必须关闭/修改的5个设置

1. 关闭【长上下文记忆】:打开config.yaml,找到memory.max_tokens,从默认4000改成2000或1000,省一半Token且日常对话完全够用。

2. 关闭【图片自动理解】:找到vision配置项,设置为enabled: false,需要时再手动开启。大多数人根本用不到这个功能。

3. 启用Prompt Caching(提示词缓存):执行openclaw config set models.cache.enabled true。原理是把不变的系统提示词、工具定义缓存起来,后续只处理动态指令。以Claude Sonnet为例,缓存读取价格只有基础价格的10%。

4. 限制文件系统权限:找到file-system skill配置,限制allowed_paths到指定目录(如下载文件夹),切勿给~/.ssh、/System等敏感目录权限。

5. 禁用官方Brave搜索:Brave注册需国外卡扣5刀,改用Tavily MCP工具或Google Custom Search API,免费额度够用。

四、高阶省钱策略:混合模型法(省95%+)

这是2026年社区公认的终极省钱秘籍——“收费模型调教 + 免费模型执行”。

收费模型“调教期”: 用收费模型(如Claude 4.6、Qwen3 Max)处理复杂任务,打磨流程、优化逻辑,最终生成本地可执行脚本。

免费模型“执行期”: 切换至免费模型(如cherry-aihubmix/coding-glm-4.7-free),直接调用已生成的成熟脚本执行重复任务,避免重复消耗收费Token。

优势: 脚本保留了收费模型的优化逻辑,免费模型仅负责执行,既保证任务效果,又将Token消耗降至最低。

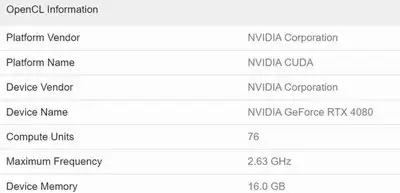

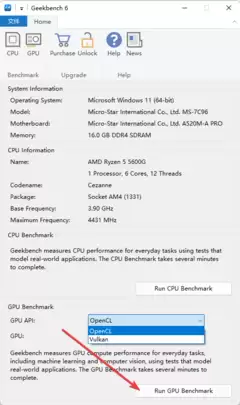

更极致:本地模型做“肌肉”。将Anthropic或ChatGPT作为OpenClaw的“大脑”负责规划,然后用本地模型(如Qwen 3.5)作为“肌肉”负责执行。执行占用了90%的Token使用量,完全免费(只需电费)。32GB内存的Mac Mini即可运行Qwen 3.5-35B-A3B。

五、终极解决方案:Viking分层路由(节省67%-93%)

这是开源社区最新推出的完整优化版OpenClaw-Viking,核心改造是在调用主模型前先用轻量本地模型判断用户意图,只加载真正需要的工具和文件。

实测节省效果:

简单对话(“你好”):优化前15,466 Tokens → 优化后1,021 Tokens,节省93%。

TTS语音+发送:15,466 Tokens → 1,778 Tokens,节省88%。

文件操作:15,466 Tokens → 3,058 Tokens,节省80%。

代码编写+运行:15,466 Tokens → 5,122 Tokens,节省67%。

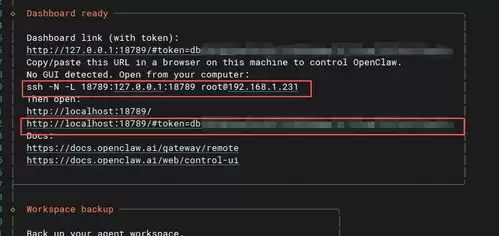

安装方法: git clone https://github.com/adoresever/AGI_Ananans.git,进入26.2.21openclaw-viking目录,执行pnpm install和pnpm build。推荐用Ollama运行GLM-4.7-Flash做路由模型(零成本)。

六、预算管控:设置熔断机制防“半夜跑飞”

在各大模型供应商的后台,设置额度告警和消费上限。例如:单日消耗超过10美元短信提醒,超过20美元自动熔断。别高估自己的控制力,AI跑起来你根本拦不住。

新手建议选带额度的套餐(如阿里基础套餐40元/月,首月7.9元),哪怕算力一下烧完了也就损失几十块。慎用“先用后付”,万一OpenClaw失控,一晚上产生几千上万元的账单就太心疼了。

来源:互联网

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- Mac卸载OpenClaw小龙虾的详细方法

- 时间:2026-06-06

-

- OpenClaw如何实现AI内容自动采集与发布的完整教程

- 时间:2026-05-31

-

- OpenClaw本地部署配置要求详解

- 时间:2026-05-25

-

- OpenClaw龙虾免费吗?使用费用与获取方式详解

- 时间:2026-05-24

-

- OpenClawAI开启GPU加速的详细步骤与配置指南

- 时间:2026-05-23

-

- 联想百应智能体OpenClaw NUC是什么功能与使用介绍

- 时间:2026-05-23

-

- OpenClawAI启用GPU加速详细教程与步骤解析

- 时间:2026-05-20

-

- OpenClawAI模型配置共享方法与步骤详解

- 时间:2026-05-19

精选合集

更多大家都在玩

大家都在看

更多-

- AutoCAD 2007面域工具使用教程与操作详解

- 时间:2026-06-07

-

- AutoCAD 2007环形阵列功能使用教程详解

- 时间:2026-06-07

-

- 受欢迎的跳跃游戏合集

- 时间:2026-06-07

-

- nero光盘刻录软件使用教程详解

- 时间:2026-06-07

-

- foobar2000中文界面设置详细教程

- 时间:2026-06-07

-

- 知网百科知识查询与学术检索官网入口指南

- 时间:2026-06-07

-

- 雷电模拟器退出时最小化到托盘设置方法

- 时间:2026-06-07

-

- 雷电模拟器4核CPU性能优化设置教程

- 时间:2026-06-07