OpenClaw为什么用DeepSeek的免费Token还是欠费了?

时间:2026-03-10 | 作者:互联网 | 阅读:0OpenClaw用DeepSeek免费Token还是欠费了?深度揭秘

满怀希望地给“小龙虾”接上DeepSeek的免费Token,结果发现还是欠费了,这几乎是每个“养虾人”都经历过的“灵异事件”。这并非DeepSeek虚假宣传,而是你对OpenClaw的“胃口”和DeepSeek的“规则”存在误解。以下是导致欠费的五大核心原因及解决方案。

一、真相:DeepSeek的“免费”是有条件的

免费额度是“体验金”而非“终生饭票”: DeepSeek为新用户提供的通常是数百万Token的免费额度,但这笔额度有有效期限制(如30天或90天)。若过期未用完,额度自动清零。有用户在微信社区反馈,“国内大模型所谓的100万token很快就用完了”。

API调用并非完全免费: 超过赠送额度后,DeepSeek会按照官方刊例价收费。虽然DeepSeek价格极低(约0.5–1元/百万Token),但在OpenClaw的消耗模式下,积少成多也会产生账单。

龙猫平台需单独申请: 如果你是通过“龙猫大模型平台”调用Deepseek-v3.2,其免费额度是分层级的:注册即得每日50万Token,申请高配额度后可获5000万Token/14天的专属额度,未申请或额度用完后将无法调用。

二、OpenClaw的“隐形消耗”远超你想象

很多人以为一次对话只消耗几十个Token,但OpenClaw的结构决定了它是个“大胃王”。

1. 每次调用的“固定成本”高达上万Token: 每次调用模型,OpenClaw都会强制携带以下内容:SOUL.md(人格设定)、AGENTS.md(代理配置)、所有启用的Skill描述、工具说明以及当前会话上下文。有开发者实测,一次完整payload固定消耗约8000–12000 Token。这意味着哪怕你只是问一句“你好”,也得先烧掉上万Token。

2. 心跳机制与后台自动轮询: 即使你没有主动对话,OpenClaw后台也可能存在心跳检测或技能自动轮询机制,持续产生Token消耗。有用户在知乎吐槽:“完全不知道它自己干了点啥,我记得只设过一个每天两次查论文的任务,结果后台每小时在用Claude opus4.6跑任务”。

三、账户与配置层面的“坑”

1. 余额不足导致服务熔断: 即使还有免费额度,如果你的DeepSeek账户绑定了支付方式且余额不足(例如为0元),当免费额度耗尽或系统误判时,会直接返回欠费错误。有用户在配置火山引擎时遭遇“反馈我系统欠费了”,整个服务被关闭。

2. 配置了多个模型,免费额度混乱: 如果你在OpenClaw中配置了多个模型(如GLM-4.7-Flash + DeepSeek),并且设置了自动切换,可能会出现“GLM免费额度用完后自动切到DeepSeek,但DeepSeek额度也已用完”的情况,导致账单产生。

3. API-Key权限不足或类型错误: DeepSeek的API-Key可能分为“对话型”和“嵌入型”等不同类型。若使用了错误类型的Key,调用时可能直接失败并提示欠费,即使账户有余额。

四、免费Token消耗过快怎么办?

1. 安装QMD技能(节省90%+): 这是2026年社区公认的“Token救星”。QMD是本地语义搜索引擎,只将与指令相关的核心片段传给模型,而非完整文件。实测每次查找从15,000 Token降至1,500 Token,长会话消耗从50万Token降至6万Token。

2. 关闭【长上下文记忆】和【自动联网】: 在config.yaml中,将memory.max_tokens从默认4000改为1000;设置browser.auto_search false和browser.confirm_before_crawl true,避免模型自动爬网页烧Token。

3. 限制系统提示词膨胀: 执行claw config set agent.auto_expand_context false和claw config set agent.max_history 10,避免每次调用都加载数千行历史记录。

4. 使用混合模型策略: 在配置文件中定义多个provider,简单任务用DeepSeek,复杂任务才用收费模型。若免费额度用尽,可设置fallback到本地Ollama模型。

5. 开启结果缓存: 执行claw config set cache.enabled true,相同指令直接返回缓存结果,不重复调用API。

五、终极零成本方案:本地部署Ollama

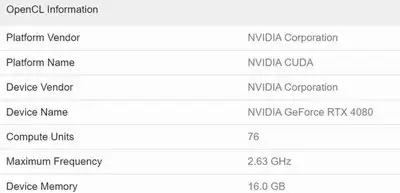

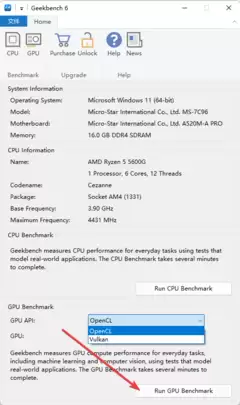

如果你不想再为Token焦虑,最彻底的方案是完全放弃云端API,改用本地模型。

操作步骤:

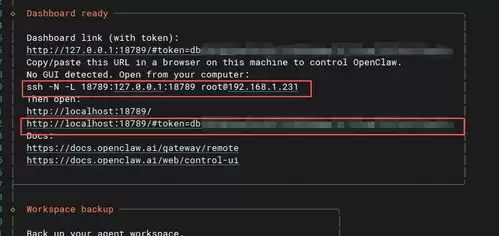

1. 安装Ollama,执行ollama run qwen2.5:7b(或更小的llama3.2:3b)。

2. 在OpenClaw配置文件中,将base_url指向本地:llm: provider: "openai" base_url: "http://localhost:11434/v1" api_key: "ollama" model: "qwen2.5:7b"。

3. 效果:模型费用直接归零,只需电费。

这种方式完全消耗本地硬件资源,不产生任何外发流量费用,且具备极高的隐私安全性。建议在配置中保留一个本地模型作为兜底逻辑,当云端免费API额度耗尽时自动切换,确保Agent任务不中断。

来源:互联网

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- Mac卸载OpenClaw小龙虾的详细方法

- 时间:2026-06-06

-

- OpenClaw如何实现AI内容自动采集与发布的完整教程

- 时间:2026-05-31

-

- OpenClaw本地部署配置要求详解

- 时间:2026-05-25

-

- OpenClaw龙虾免费吗?使用费用与获取方式详解

- 时间:2026-05-24

-

- OpenClawAI开启GPU加速的详细步骤与配置指南

- 时间:2026-05-23

-

- 联想百应智能体OpenClaw NUC是什么功能与使用介绍

- 时间:2026-05-23

-

- OpenClawAI启用GPU加速详细教程与步骤解析

- 时间:2026-05-20

-

- OpenClawAI模型配置共享方法与步骤详解

- 时间:2026-05-19

精选合集

更多大家都在玩

大家都在看

更多-

- AutoCAD 2007面域工具使用教程与操作详解

- 时间:2026-06-07

-

- AutoCAD 2007环形阵列功能使用教程详解

- 时间:2026-06-07

-

- 受欢迎的跳跃游戏合集

- 时间:2026-06-07

-

- nero光盘刻录软件使用教程详解

- 时间:2026-06-07

-

- foobar2000中文界面设置详细教程

- 时间:2026-06-07

-

- 知网百科知识查询与学术检索官网入口指南

- 时间:2026-06-07

-

- 雷电模拟器退出时最小化到托盘设置方法

- 时间:2026-06-07

-

- 雷电模拟器4核CPU性能优化设置教程

- 时间:2026-06-07