OpenClaw如何手写配置文件或修改模型?

时间:2026-03-10 | 作者:互联网 | 阅读:0OpenClaw如何手写配置文件或修改模型

手写配置文件和修改模型是掌控“小龙虾”的必经之路。OpenClaw的核心配置文件是openclaw.json(部分旧版本为clawdbot.json),采用JSON5格式,支持注释和尾随逗号,对新手非常友好。以下是手写配置和修改模型的完整指南。

一、配置文件在哪里?

不同部署方式的配置文件路径略有差异:

Docker部署(官方推荐):宿主机路径为~/.openclaw/openclaw.json,容器内路径为/app/.clawdbot/clawdbot.json。直接在宿主机用记事本或VSCode编辑即可,修改后重启容器生效。

一键脚本安装:路径为/root/.openclaw/openclaw.json。

源码手动部署:项目根目录下的openclaw.json,建议复制到~/.openclaw/统一管理。

快速定位命令:执行docker exec -it openclaw bash进入容器,cd /app/.clawdbot查看文件。

修改前必做备份:执行cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak,避免改错回不去。

二、配置文件整体结构

打开文件后,你会看到分层清晰的JSON结构,核心模块如下:

{ "agents": { ... }, // 控制AI行为、Token消耗、记忆策略(90%的优化在这里) "models": { ... }, // 模型服务商配置(Kimi/OpenAI/Claude等) "channels": { ... }, // 聊天渠道(Telegram/WhatsApp/飞书等) "gateway": { ... }, // 网关端口、监听地址 "session": { ... }, // 会话重置、上下文管理 "cache": { ... }, // 缓存策略,重复查询省Token "tools": { ... } // 工具权限控制 }

三、修改模型:添加新模型服务商

修改模型的核心是操作models.providers字段。以下以几种常用模型为例:

1. 配置Kimi(月之暗面):

"models": { "providers": { "moonshot": { "type": "moonshot", "apiKey": "你的Kimi API密钥", "baseUrl": "https://api.moonshot.ai/v1", // 香港/海外用.ai,大陆服务器换.cn "api": "openai-completions", "models": [ { "id": "kimi-k2.5", "name": "Kimi K2.5", "contextWindow": 256000, "maxTokens": 8192 } ] } } }

2. 配置硅基流动SiliconFlow(支持DeepSeek等):

"models": { "providers": { "siliconflow": { "baseUrl": "https://api.siliconflow.cn/v1", "apiKey": "你的API密钥", "api": "openai-completions", "models": [ { "id": "deepseek-ai/DeepSeek-V3.2", "name": "DeepSeek-V3.2" } ] } } }

3. 配置本地Ollama模型(完全免费):

"models": { "providers": { "ollama": { "baseUrl": "http://host.docker.internal:11434/v1", // Docker内访问宿主机 "apiKey": "ollama", "api": "openai-completions", "models": [ { "id": "qwen2.5:7b", "name": "本地Qwen2.5-7B" } ] } } }

4. 配置OpenAI GPT:

"models": { "providers": { "openai": { "baseUrl": "https://api.openai.com/v1", "apiKey": "你的OpenAI密钥", "api": "openai-completions", "models": [ { "id": "gpt-5.2", "name": "GPT-5.2" } ] } } }

5. 通用模板(适配任意OpenAI兼容接口):

{ "base_url": "API地址", "api_key": "你的密钥", "model_id": "模型ID" }

四、配置默认模型

添加完模型服务商后,需要在agents.defaults.model.primary中指定默认使用的模型:

"agents": { "defaults": { "model": { "primary": "siliconflow/deepseek-ai/DeepSeek-V3.2" // 格式:服务商名/模型ID } } }

也可为特定模型设置参数(如temperature):

"agents": { "defaults": { "models": { "moonshot/kimi-k2.5": { "alias": "Kimi K2.5", "params": { "temperature": 0.2 // 低温度,减少Token消耗 } } } } }

五、修改后验证与生效

1. 重载配置:大部分参数支持热重载,执行docker exec -it openclaw openclaw models reload或openclaw gateway restart(改端口等核心配置必须重启)。

2. 验证模型列表:执行docker exec -it openclaw openclaw models list,看到刚配置的模型且有default标签即成功。

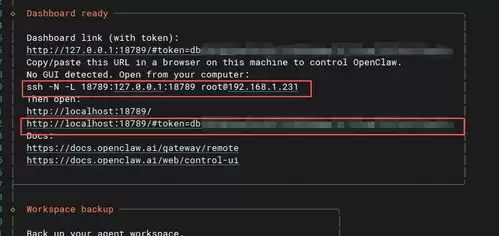

3. 聊天验证:在Web界面(http://127.0.0.1:18789)或Telegram中直接问“当前使用什么模型?”,AI会如实相告。

4. 使用诊断工具:执行openclaw doctor --fix可自动检查语法错误并修复。

六、核心优化参数(省Token的关键)

在agents.defaults中调整以下参数,可大幅降低Token消耗:

temperature:推荐设为0.2,能减少模型瞎编,降低重试次数。

compaction.reserveTokensFloor:自动压缩阈值,超过此Token数就压缩历史,推荐20000。

compaction.memoryFlush.enabled:记忆刷新,开启后把关键信息存文件,清空冗余上下文,必开。

heartbeat.every:空闲重置,“30m”表示30分钟无消息自动开新会话,省Token核心配置。

contextTokens:最大上下文窗口,Kimi 2.5支持256000,保持默认即可。

七、安全配置(必做)

在channels中配置访问权限,防止他人滥用你的API额度:

"channels": { "whatsapp": { "allowFrom": ["+861234567890"] // 只允许你的手机号 } }

八、常见坑点与避坑指南

修改后没效果:忘记保存/路径错了/没重载。确认宿主机路径正确,执行openclaw models reload。

JSON格式错误:多了逗号或引号不匹配,用在线JSON校验工具(如jsonlint.com)检查。

API Key无效:确保密钥前后无空格,账户未欠费。硅基流动等平台API Key仅创建时显示一次,丢失需重新生成。

国内地域网络问题:使用阿里云/华 为云国内服务器时,如需调用海外API,注意网络延迟或换用国内模型(如MiniMax国内版baseUrl为api.minimax.com)。

容器重启后配置丢失:Docker启动命令必须包含-v ~/.openclaw:/app/.clawdbot挂载卷。

不要重用Agent目录:多Agent场景下,每个Agent需独立工作区,否则认证失败。

BOOTSTRAP.md不要手动创建:会导致Agent卡在初始化状态。

来源:互联网

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- OpenClaw命令行从零一步步使用方法的详细指南新手必备

- 时间:2026-06-08

-

- Mac卸载OpenClaw小龙虾的详细方法

- 时间:2026-06-06

-

- OpenClaw如何实现AI内容自动采集与发布的完整教程

- 时间:2026-05-31

-

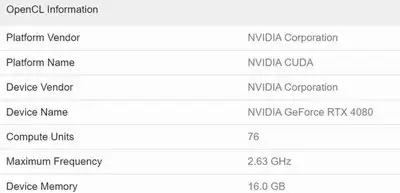

- OpenClaw本地部署配置要求详解

- 时间:2026-05-25

-

- OpenClaw龙虾免费吗?使用费用与获取方式详解

- 时间:2026-05-24

-

- OpenClawAI开启GPU加速的详细步骤与配置指南

- 时间:2026-05-23

-

- 联想百应智能体OpenClaw NUC是什么功能与使用介绍

- 时间:2026-05-23

-

- OpenClawAI启用GPU加速详细教程与步骤解析

- 时间:2026-05-20

精选合集

更多大家都在玩

大家都在看

更多-

- AutoCAD 2007面域工具使用教程与操作详解

- 时间:2026-06-07

-

- AutoCAD 2007环形阵列功能使用教程详解

- 时间:2026-06-07

-

- 受欢迎的跳跃游戏合集

- 时间:2026-06-07

-

- nero光盘刻录软件使用教程详解

- 时间:2026-06-07

-

- foobar2000中文界面设置详细教程

- 时间:2026-06-07

-

- 知网百科知识查询与学术检索官网入口指南

- 时间:2026-06-07

-

- 雷电模拟器退出时最小化到托盘设置方法

- 时间:2026-06-07

-

- 雷电模拟器4核CPU性能优化设置教程

- 时间:2026-06-07