智能体工程成熟度模型:8个进阶等级详解(附评估框架与实践路径)

时间:2026-03-17 | 作者: | 阅读:0作者:Bassim Eledath

编译:宝玉

欧意官网地址:点击进入〉〉〉

欧意app下载地址:点击下载〉〉〉

币安官网地址:点击进入〉〉〉〉

币安app下载地址:点击下载〉〉〉

AI 的编程能力正在跑在我们前面——不是慢半拍,是甩开一大截。你刷 SWE-bench 刷到凌晨三点,分数涨了 2.3%,可工程团队的周交付量纹丝不动。Anthropic 团队十天上线 Cowork;隔壁组用同一版 Claude,卡在 POC 阶段三个月,连一个能跑通的端点都交不出来。差别不在模型,在人和模型之间那层薄薄的、却无比关键的实践膜——有人已经把它捅破了,有人还在反复摸墙。

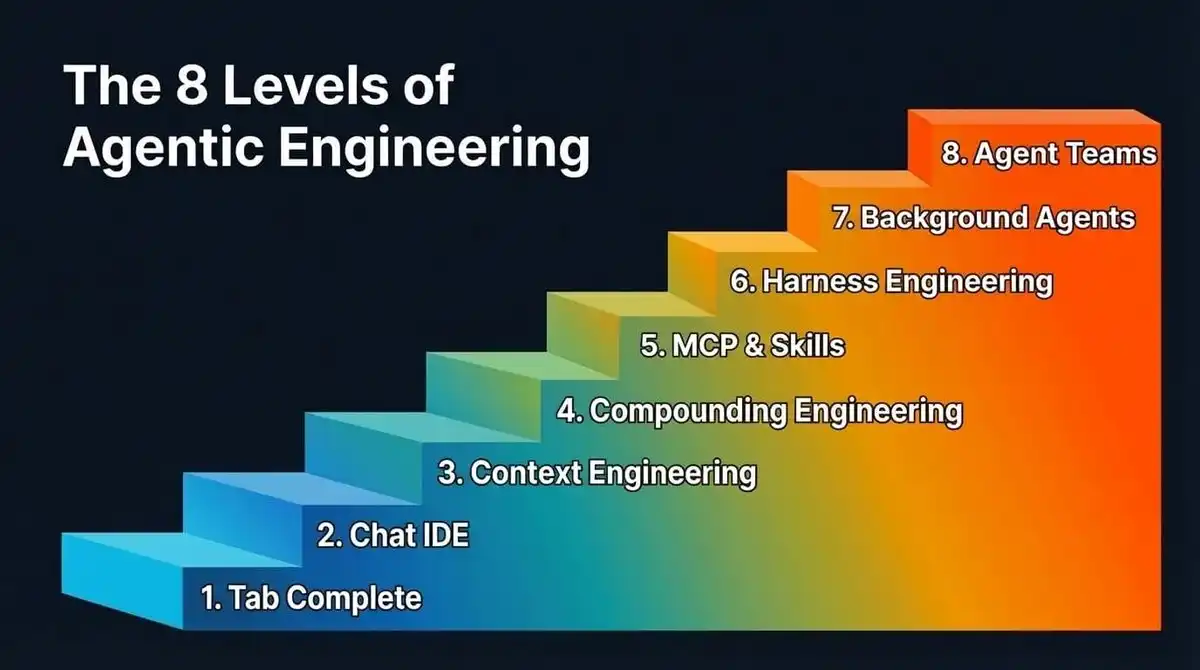

这层膜不是一道闸门,而是一道斜坡。八级,一级一级往下沉,又一级一级往上走。你大概已经踩过前几级台阶。脚底能感觉到那种微妙的抬升感:每跨一级,手里的键盘就轻一分,脑子里的“下一步该写什么”就少一句,而 PR 列表里自动冒出来的绿色合并按钮就多一个。更妙的是,模型每次升级,都会把这级台阶垫得更高——你站在上面,看得更远,跳得更稳。

还有一件事你可能没意识到:你的等级,会被队友的等级拖住。你是 7 级,晚上睡觉时后台智能体已经在提第三轮 PR;但审批链上卡着一位 2 级同事,他还在手动点开每个 diff,一行行比对,查 import 是否多余,看变量命名是否符合驼峰。你的吞吐量,就钉死在他刷新页面的那一刻。帮他升一级,不是施舍,是给自己松绑。

这些等级不是我闭门造车列出来的。它们长在 Slack 频道里、GitHub PR 评论中、深夜 Zoom 共享屏幕的终端窗口上。我和三十多个团队聊过他们怎么让 AI 写代码——不是理论,是今天早上刚 merge 的那个修复,是昨天下午被 rollback 的那个自动化部署,是上周五凌晨三点突然弹出的 CI 失败告警。以下是它们自然生长出来的路径(顺序不是铁律,但方向不会骗人):

智能体工程的 8 个等级

第 1 和第 2 级:Tab 补全与智能体 IDE

这两个等级,我们一笔带过。不是不重要,而是像呼吸一样自然——你甚至意识不到自己正在做。

Tab 补全是起点。GitHub Copilot 按下 Tab 的那一声轻响,就是这场变革的第一声心跳。老手靠它填肉:骨架早搭好了,函数签名写完了,只差中间那几行胶水逻辑。新人反而容易卡在这儿——没骨架,AI 就只能胡乱拼凑。它从不教你怎么设计,只帮你把想清楚的事更快地敲出来。

Cursor 这类 AI 原生 IDE 把游戏规则改了。聊天框不再悬浮在角落,它直接长进你的代码树里。你右键一个 service 文件夹,选“重构为领域驱动结构”,它立刻拉出整个依赖图,跨五个文件重写接口。但天花板始终压在上下文上:模型只看见你塞给它的那几百行,看不见隔壁模块里一个埋了三年的 bug,也看不见 README 里那句“切勿在 init 中调用外部 API”。它要么饿着,要么撑吐。

这个阶段的人,几乎都在用计划模式:先让 LLM 把模糊想法拆成 step 1、2、3……再让它执行。效果不错,控制感强。但你会慢慢发现,自己越来越懒得写 step 3——因为 step 2 总是悄悄替你把 step 3 干了。这不是失控,是预演。

第 3 级:上下文工程

这里开始有温度了。

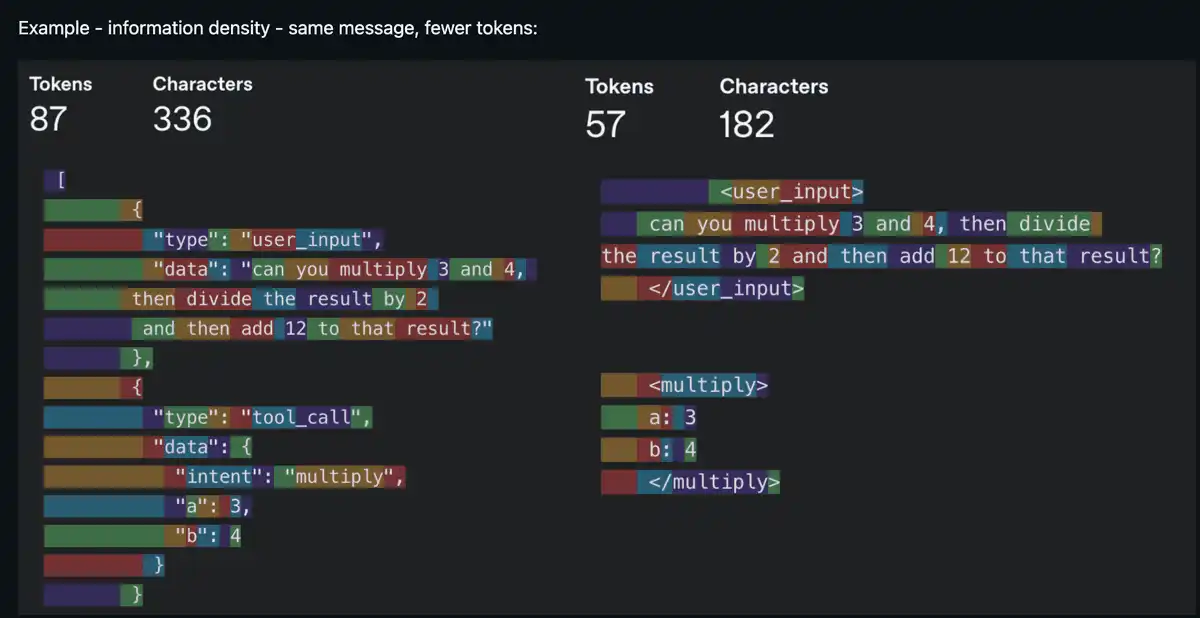

“上下文工程”这个词在 2025 年夏天突然爆火,不是因为大家发明了新东西,而是模型终于肯听话了——只要你给的指令干净,上下文精准,它真能照着做。嘈杂的上下文和空荡的上下文一样致命。所以所有人突然开始抠 token:删掉注释里的“TODO”,压缩 JSON 示例,把三段式系统提示缩成一行动词短语。“每个 token 都得为自己在提示词里的位置拼命”——那是我们当时的口头禅。

同样的信息,更少的 token——信息密度才是王道(来源:humanlayer/12-factor-agents)

上下文工程远不止写好 system prompt。它是你 .cursorrules 里那三条不妥协的规则;是你给每个工具写的两句话描述——模型靠这个判断该不该调用 Playwright;是你每天清空对话历史的习惯,因为第十轮时它已经忘了自己第一轮承诺过不修改 config.yaml;也是你每次只暴露三个工具的克制——选项太多,它会像人一样发呆。

现在你很少听见“上下文工程”这个词了。模型变宽容了,能嚼碎更乱的输入,更大的上下文窗口也让“压缩会话”的弹窗出现得越来越晚。但它没消失,只是换了一副面孔:从前拼了命过滤噪音,现在拼了命确保对的上下文,在对的时间,刚好落在模型视网膜中央。这个转向,正是第 4 级的伏笔。

第 4 级:复合工程

第 3 级优化的是这一轮对话。第 4 级优化的是所有未来的对话。

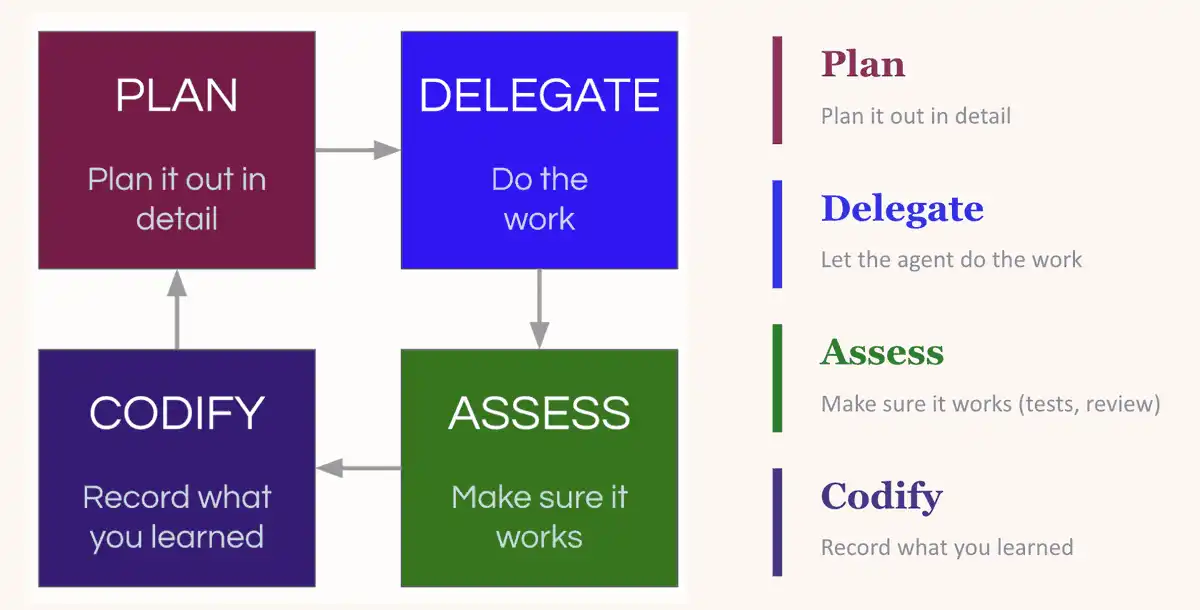

Kieran Klaassen 提出的“复合工程”(Compounding Engineering),第一次让我后颈发麻。原来“凭感觉编程”不是玄学,是可以沉淀、可以复利、可以滚雪球的。它是一个闭环:计划 → 委派 → 评估 → 沉淀。你规划任务,喂够上下文;你放手让它干;你盯着输出,看哪里歪了;然后最关键的——你把这次歪掉的地方,变成下次不歪的锚点。

复合循环:计划、委派、评估、沉淀——每一轮都让下一轮更好

魔力全在“沉淀”二字。LLM 是健忘的。昨天你亲手删掉的旧 SDK,今天它又热情洋溢地加回来——除非你把它写进 CLAUDE.md。但别一股脑全塞进去。规则文件不是垃圾桶,塞满等于失效。更好的办法是建一个 docs/ 文件夹,里面放着实时更新的架构决策记录(ADR)、API 变更日志、已知陷阱清单。让 LLM 自己去翻,而不是你替它背。

做到这级的人,遇到报错第一反应不是骂模型蠢,而是翻上下文:“我漏了哪条约束?是不是没告诉它这个函数必须幂等?”正是这种肌肉记忆,托住了后面四级的全部重量。

第 5 级:MCP 与技能

第 3、4 级解决“看到什么”。第 5 级解决“能做什么”。

MCP(Model Context Protocol)和自定义技能,是给 LLM 装上手脚。它不再只思考你的代码库,它开始操作:查数据库、调 CI、跑 Playwright、发 Slack 通知。模型从大脑,变成了手脚俱全的工人。

我们团队共享一个 PR 审查技能。它不是静态的,每周都在迭代:上周加了安全子智能体,专盯 SQL 注入;这周加了复杂度分析器,自动标出嵌套超过五层的 if;下周准备接入提示词健康度扫描——确保所有 PR 描述都遵循 team-standard.md 格式。它顺手跑 linter 和 Ruff,像呼吸一样自然。

为什么砸这么多时间在审查上?因为当智能体批量产 PR 时,人工审查就从质量守门员,退化成了吞吐量瓶颈。Latent Space 那篇《Reviews Are Dead》说得赤裸:我们熟悉的 Code Review 已死。活下来的是自动的、一致的、由技能驱动的审查流水线。

我用 Braintrust MCP 让 LLM 直接查询评估日志并反向修改提示词;用 DeepWiki MCP 让它秒读任意开源仓库文档,不用再把整份 README 塞进上下文。

当三个人各自写了五个相似的“检查 CI 状态”技能时,是时候建 registry 了。Block 那篇《3 Principles for Designing Agent Skills》写得透:他们内部技能市场已有超百个技能,按角色打包成套餐。技能和代码同等待遇——PR、审查、版本历史,一个都不能少。

还有一个悄然崛起的趋势:CLI 正悄悄取代 MCP。Google Workspace CLI、Braintrust 即将发布的 CLI……原因很实在:token 效率。MCP 每轮都把全部工具定义轰进上下文,不管用不用;CLI 是按需调用,只把命令输出喂进来。所以我现在用 agent-browser 而非 Playwright MCP——省下的 token,够它多跑两次验证。

停一下。第 3 到第 5 级,是地基。LLM 在某些事上惊人地准,在另一些事上惊人地瞎。你需要亲手摸过几十次它的边界,才能培养出那种直觉:什么时候该收紧上下文,什么时候该放开工具权限,什么时候该加回压而不是加提示。如果地基松了,第 6 级的自动化只会放大错误,而不是加速交付。

第 6 级:Harness Engineering

火箭点火了。

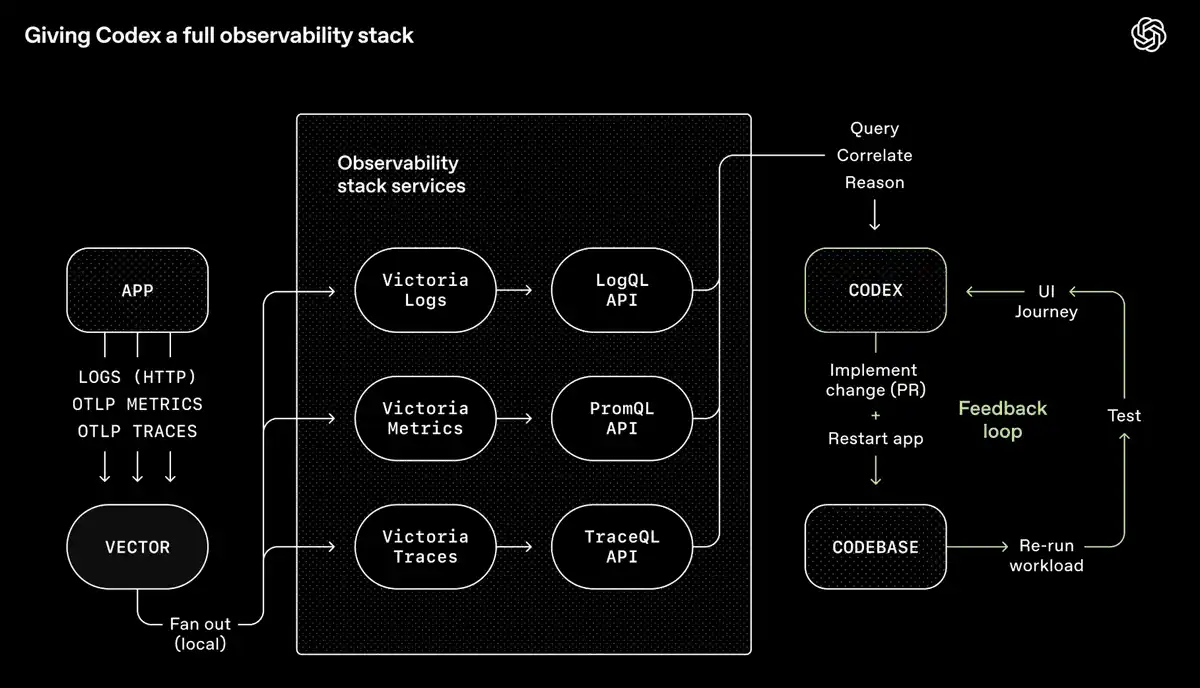

上下文工程管模型“看见什么”。Harness Engineering 管整个世界“如何运转”——工具链、可观测性、反馈循环,一切为了让智能体在你离线时,依然能自己发现问题、修复问题、验证修复、提交 PR、回应 review、最终合入主干。你给它的不是编辑器,是一套完整的生命支持系统。

OpenAI 的 Codex 工具链——一套完整的可观测性系统,让智能体可以查询、关联和推理自己的输出(来源:OpenAI)

Codex 团队把 Chrome DevTools、日志查询、UI 自动化全塞进智能体运行时。给它一个 bug 描述,它能:复现 → 截屏 → 录制视频 → 修改代码 → 启动应用验证 → 提交 PR → 解读 reviewer 的 comment → 再次修改 → 合并。它不只写代码,它看代码跑起来的样子,然后迭代——像人类一样。

我的团队做故障排查智能体,所以我写了 converse CLI:任何 LLM 都能通过它和线上后端逐轮对话。LLM 改完代码,converse 立刻在生产环境跑测试流,失败就重来。有时这个循环自己跑了三小时,直到对话流程完全符合预期——比如必须在用户说“转人工”时触发特定 webhook。

这一切的脊椎,是回压机制(Backpressure)。类型系统、测试、linter、pre-commit 钩子——它们不是装饰,是护栏。没有护栏的自主性,只是失控的加速。Vercel CTO 说得尖锐:智能体、它生成的代码、你的密钥,必须分属不同信任域。一条藏在日志里的提示词注入,就能让它把 AWS 凭证吐进 Slack——如果所有东西都在同一个安全上下文里。

两个原则让 Harness 更真实:

为吞吐量设计,不为完美设计。要求每次 commit 零缺陷,智能体会在同一个 bug 上无限 loop,互相覆盖。容忍小错,留到最后统一验收——就像我们对待人类同事。 约束优于指令。“先 A,再 B,再 C”正在失效。模型会死磕步骤,忽略目标。更好的提示是:“这是验收标准,一直做,直到所有测试通过。”Harness 的另一半,是让智能体在代码库里认路。OpenAI 的 AGENTS.md 控制在 100 行内,只作目录索引;其余文档结构化、版本化,CI 流程自动校验时效性——拒绝靠人想起来更新。

当你把这一切搭好,一个问题会浮上来:如果智能体能自验、自修、自导、自航——那你坐在椅子上,到底在干什么?

提醒一句:如果此刻你还在第 2 级,接下来的内容可能像科幻小说。没关系,先存着。等某天你发现自己在写 CLAUDE.md 时手速变快了,再回来。

第 7 级:后台智能体

辣评:计划模式,正在慢性死亡。

Claude Code 的 Boris Cherny 现在仍有 80% 的任务以计划模式启动。但每一代新模型发布,一次性成功率都在爬升。临界点快到了:计划不再需要你手动介入。不是计划不重要了,而是模型自己学会了——前提是你把第 3 到第 6 级的地基打牢了。上下文干净、约束清晰、工具定义准确、反馈循环闭合,模型才敢在你眼皮底下自己画蓝图。

计划没消失,只是变形了。对新手,它仍是分步大纲;对第 7 级的复杂需求,它变成一场探索:探查代码库拓扑、在 worktree 里快速原型、摸清解空间边界。而越来越多时候,这场探索,是后台智能体替你做的。

这才是质变。当智能体能可靠规划并执行,无需你签字,它就能在你开会、吃饭、睡觉时异步推进。你从“同时切换十个标签页”,变成“工作在没有你的情况下持续涌动”。

Ralph 循环 是经典入口:一个自主智能体循环,反复运行编程 CLI,直到 PRD 所有事项完成,每次启动全新上下文。但在我手里,它常因 PRD 里一句模糊的“提升用户体验”而崩盘——模型会自己发挥,造出五个你根本没想到的 UI 组件。它太“扔出去就不管了”。

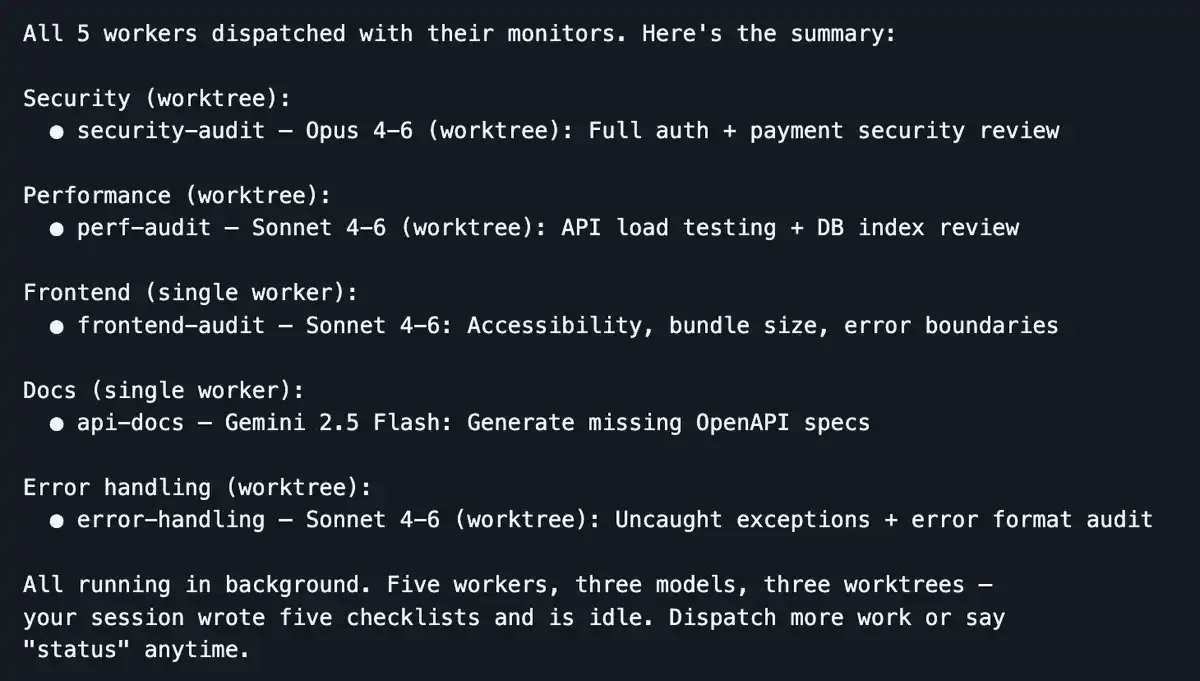

你可以并行跑十个 Ralph 循环,但很快会发现时间都花在哪了:协调谁先谁后,检查谁卡住了,合并谁的输出。你不再写代码,你成了调度员。这时你需要一个编排智能体——它管计划、委派、跟踪,让你的主会话只负责意图,不操心后勤。

Dispatch 跨 3 个模型并行启动 5 个 worker——你的会话保持精简,智能体在干活

我最近高频使用的,是 Dispatch——我写的 Claude Code 技能。它把你当前会话变成指挥中心:你留在干净的上下文中,worker 在隔离环境里扛活。调度器管分配、追踪、兜底;主窗口永远轻盈。当 worker 卡住,它会抛出澄清问题,而不是静默失败。

Dispatch 本地运行,适合快速迭代:反馈快、调试近、零基础设施。而 Ramp 的 Inspect 是互补方案:每个智能体在云端沙箱 VM 中启动,自带完整开发环境。PM 在 Slack 标记 UI bug,你合上笔记本,Inspect 就接手了。代价是运维复杂性,换来的是本地无法企及的规模与可复现性。我两个都用——本地搞原型,云端跑长任务。

一个意外强大的模式:混用模型。最好的团队不是克隆人军团。Opus 负责实现,Gemini 做探索性研究,Codex 专司审查。它们后训练路径不同,性格迥异,综合产出远超单模。这是群体智慧,在代码上落地。

至关重要的一课:实现者和审查者必须解耦。我栽过太多跟头——同一个模型实例既写代码又自我审查,它会本能忽略盲点,告诉你“全部完成”,其实漏洞明晃晃。这不是恶意,是认知偏见。就像你不给自己考试打分。让另一个模型,或另一个带专用审查提示词的实例,来做终审。信号质量,立竿见影。

后台智能体,也打开了 CI 与 AI 的融合闸门。一旦它能在无人值守下运行,就能从现有管道触发:文档机器人每次 merge 后自动生成新版 CLAUDE.md 并提 PR;安全机器人扫描 PR,直接提交修复;依赖管理机器人不只是报警,它升级包、跑测试、提 PR。好的上下文、持续沉淀的规则、强大的工具、自动化的反馈——现在,它们全在自主呼吸。

第 8 级:自主智能体团队

没人真正站稳这一级。但有人正把脚趾伸进去。

第 7 级是中心辐射:一个编排 LLM 向多个 worker 分发任务。第 8 级砍掉了中心。智能体之间直接对话、认领任务、共享发现、标记阻塞、协商冲突——不经过任何单一调度者。

Claude Code 的实验性 Agent Teams 是早期形态:多个实例共享代码库,并行工作,彼此在各自上下文窗口中直接通信。Anthropic 用 16 个并行智能体,从零构建出能编译 Linux 的 C 编译器;Cursor 运行数百并发智能体数周,从零写出浏览器,并把自己的代码库从 Solid 迁移到 React。

但细看裂缝。Cursor 发现:去掉层级后,智能体集体陷入犹豫,原地打转;Anthropic 的智能体反复破坏已有功能,直到加入 CI 流水线防回归才稳定。所有试水者都说同一件事:多智能体协调,是硬骨头,尚无银弹。

实话说,我不信模型已准备好接管大多数任务。即使它足够聪明,对编译器和浏览器之外的项目,它仍太慢、太费 token、太不经济(震撼,但远未成熟)。对我们日常所做之事,第 7 级已是真正的杠杆支点。我不意外第 8 级终成主流,但此刻,我会把力气全押在第 7 级——除非你是 Cursor,突破本身就是你的业务。

第 级

“接下来呢?”这个问题,总会浮现。

当你能流畅编排智能体团队而不卡壳,文本界面就显得笨重了。语音对语音(思维对思维?)的交互——对话式 Claude Code,而非语音转文字的输入——是自然的延伸。看着你的应用,对着空气说:“把登录页的加载状态改成骨架屏,错误提示加图标,三秒后自动重试”,然后看着改动在眼前发生。

有一群人在追逐完美的一次性生成:你说需求,AI 一步到位。问题在于,这假设我们确切知道自己想要什么。但我们不知道。从来都不知道。软件开发本就是迭代的,它永远会是。只是迭代会变得轻如呼吸,远超纯文本的桎梏,快得让你来不及眨眼。

所以:你在哪个等级?你在做什么,让自己明天比今天高半级?

你在哪个等级?

你通常怎么用 AI 开始一个编程任务?

来源:https://www.bitalk8.com/article/61445

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- 2026年币圈三大交易所安全下载指南:币安、欧易、Gate官方渠道

- 时间:2026-03-13

-

- Pump.fun(PUMP币)是什么?值得投资吗?PUMP币未来价格预测

- 时间:2026-03-11

-

- Warden Protocol空投指南:通过AI驱动活动赚取$WARD代币

- 时间:2026-03-11

-

- CoinRaces空投指南:通过预测迷因币赚取$CRGG代币

- 时间:2026-03-11

-

- SPACE币价格今日行情

- 时间:2026-01-29

-

- SERV币价格今日行情

- 时间:2026-01-23

-

- 雪球币价格今日行情

- 时间:2026-01-22

-

- AIA币价格今日行情

- 时间:2026-01-22

精选合集

更多大家都在玩

大家都在看

更多-

- 星神纪元英灵美狄亚怎么打

- 时间:2026-03-17

-

- 北字开头的网名男生霸气(精选100个)

- 时间:2026-03-17

-

- 生存33天亡灵祭祀攻略指南

- 时间:2026-03-17

-

- 三国志幻想大陆2枭之歌执命武将介绍

- 时间:2026-03-17

-

- 帝国史诗技能怎么搭配

- 时间:2026-03-17

-

- 魔兽世界苦闷的新兵任务怎么过

- 时间:2026-03-17

-

- 网友抹黑胖东来被起诉后反向求职:我错了 顺便给我找份工作

- 时间:2026-03-17

-

- 王姓艺术名男生霸气网名(精选100个)

- 时间:2026-03-17