豆包Seed 2.0 Lite升级全模态理解模型看懂听懂更多内容

时间:2026-05-12 | 作者:318050 | 阅读:0火山引擎昨日发布消息,豆包大模型家族中的全模态理解模型Doubao-Seed-2.0-lite迎来升级。

新版本主打“原生统一”。这意味着视频、图像、音频、文本等不同形态的信息,现在能被置于同一个框架内进行理解。

同时,其Agent(智能体)、Coding(代码)和GUI(图形界面)能力也同步升级。目标明确:应对更复杂、更考验综合推理能力的业务场景。

视觉理解:不止“看见”,更要“看懂”

视觉能力是模型比拼的焦点。Doubao-Seed-2.0-lite在此继续加码。

在一些高阶学科推理任务上,如物理领域的HiPhO、医疗领域的MedXpertQA,其表现已超过今年2月发布的、定位更高的Doubao-Seed-2.0-pro版本。

同时,在细粒度任务上,如BabyVision(婴儿视觉)、WorldVQA(世界问答),以及需要结合物理世界理解的ERQA(具身问答)等领域,新版本达到了业界领先的SOTA水平。

这意味着它在工业质检、医疗影像分析、自动驾驶环境感知等高价值、高精度场景中,将更具应用潜力,也更易于企业规模化部署。

加粗表示最优结果,下划线表示次优结果

跨模态融合:当声音遇见画面

本次升级的重头戏是融入语音理解能力。这并非简单功能拼接,而是实现了多模态的联合推理。

在视频理解场景下,新版模型可同时分析画面与背景音频,精准判断视频的“视听一致性”。这对于内容安全审核至关重要。

它还能根据自然语言指令,如“找出主角第一次出现惊讶表情的时刻”,在长视频中精准定位。

更强大的是,它能跨越多个时间片段,提取关键线索,持续追踪人物或事件的发展脉络,并进行多步逻辑推理,还原事件的前因后果。

音频能力:从转写到“读懂”情绪

音频方面,新模型支持19种语言的精准语音转写,以及中英文与另外14种语言之间的互译。

但其能力不止于此。它还能:

- 捕捉语音中的细微情绪变化

- 分辨环境背景声

- 识别音乐细节

这使得其输出不再是干巴巴的文字稿,而是更完整、更接近人类真实认知的语义信息。这对客服质检、情感分析、媒体内容生产等场景价值显著。

根据公开评测集数据,Doubao-Seed-2.0-lite在语音识别、翻译等多项音频理解基准测试上,表现优于谷歌的Gemini-3.1-Pro模型。

智能体与持续学习

另一个亮点是,Doubao-Seed-2.0-lite深度适配了OpenClaw、Hermes Agent等主流智能体框架。

这意味着其深度搜索和技能动态调用能力得到强化。更重要的是,它在执行任务过程中可以持续沉淀经验,实现“越用越聪明”的进化效果。

这对于需要长期、复杂交互的AI应用而言,显著增加了其生命力和实用性。

总结

本次升级清晰地指向一个趋势:大模型正从单一模态的“专家”,加速进化为能同时处理、关联、推理多种信息的“通才”。

这场“全模态”竞赛,已深入到具体业务场景的毛细血管之中。

来源:整理自互联网

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

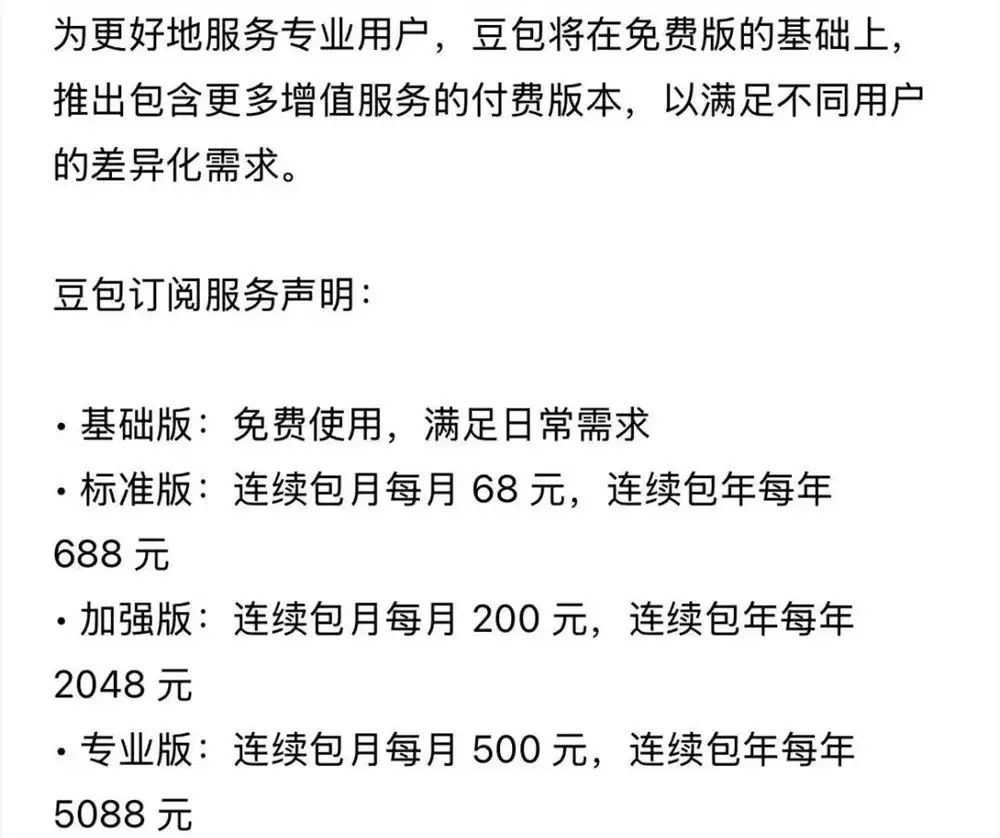

- 豆包付费订阅模式上线 专注生产力场景升级服务体验

- 时间:2026-05-11

-

- 豆包付费是字节整理Agent生态的开始

- 时间:2026-05-11

-

- 元宝与豆包哪个更好用深度对比分析

- 时间:2026-05-11

-

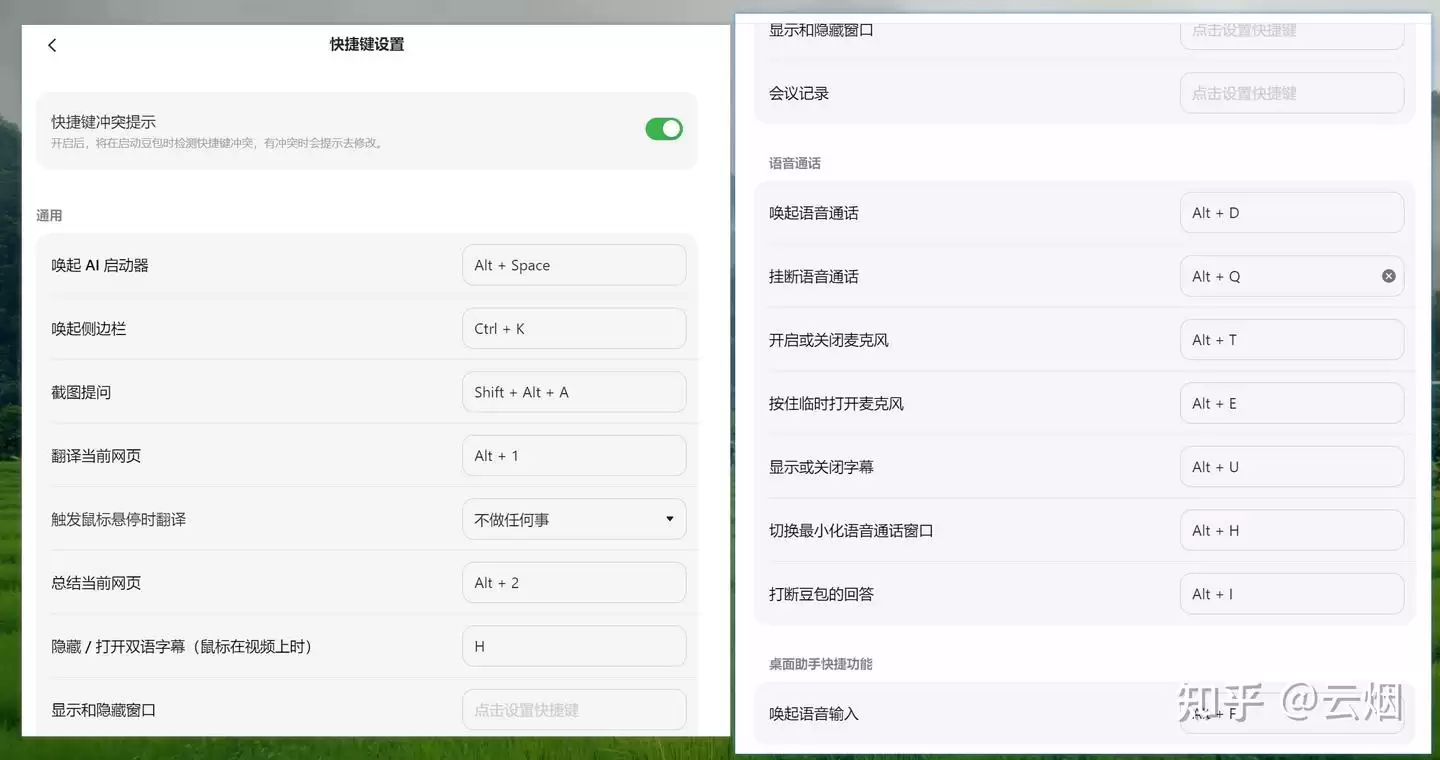

- 豆包语速调节方法详解 如何调整豆包语音播放速度

- 时间:2026-05-10

-

- 豆包克隆音色教程详解 手把手教你复刻声音

- 时间:2026-05-08

-

- 豆包语音更换方法详细步骤教程

- 时间:2026-05-08

-

- 怎样用豆包应用生成做小游戏-如何借助豆包应用生成制作小游戏

- 时间:2026-05-06

-

- 继豆包之后 OpenAI杀入手机赛道:全球首发定制版天玑9600

- 时间:2026-05-06

精选合集

更多大家都在玩

大家都在看

更多-

- 电饼铛怎么选?性价比高这么挑!

- 时间:2026-05-12

-

- 汽车音响接线图必须匹配车型吗?

- 时间:2026-05-12

-

- 团队互动游戏推荐

- 时间:2026-05-12

-

- vivo X27刷机会丢保修吗?附刷机教程

- 时间:2026-05-12

-

-

- 谷歌浏览器查看已保存密码的详细步骤与凭证管理

- 时间:2026-05-12

-

- 安卓平板续航一般多久?怎么选才耐用?

- 时间:2026-05-12

-

- 空调制冷效果差?教你快速降温小妙招

- 时间:2026-05-12