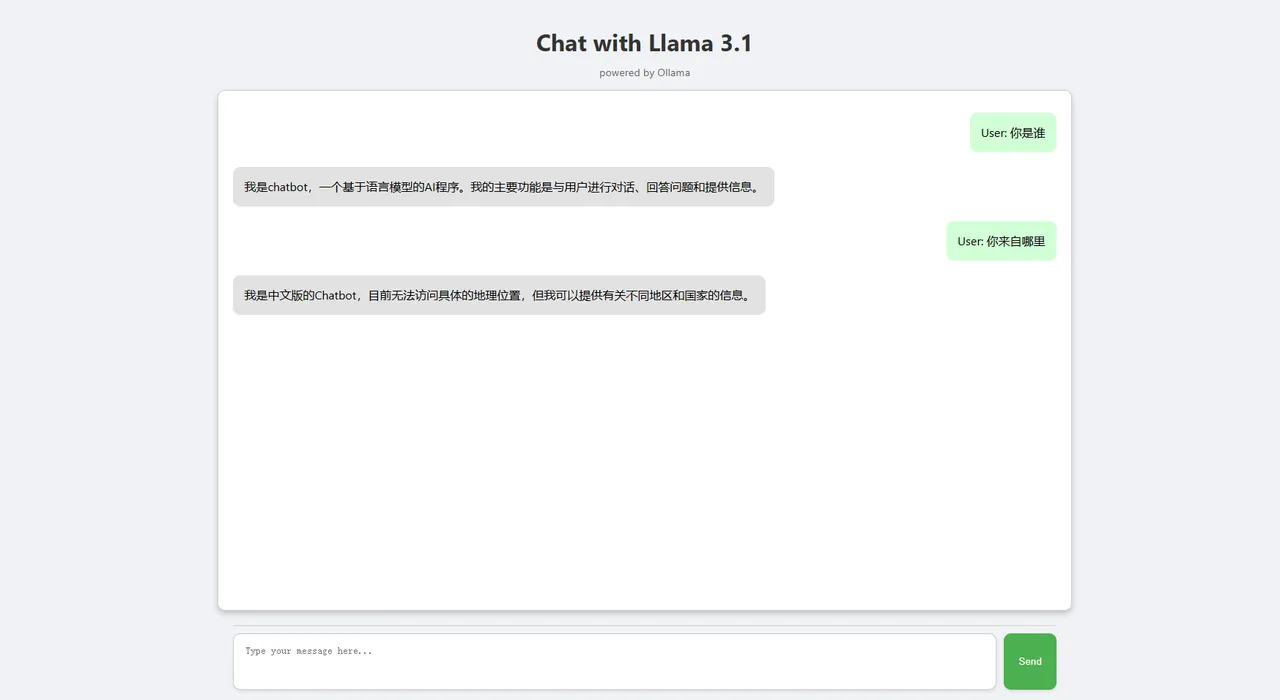

FastAPI 部署 Ollama 可视化对话界面

时间:2025-03-18 | 作者: | 阅读:0一、目录结构

仓库 notebook 的 c6 文件夹下:

fastapi_chat_app/│├── app.py├── websocket_handler.py├── static/│ └── index.html└── requirements.txt登录后复制

- app.py?FastAPI 应用程序的主要设置和路由。

- websocket_handler.py?处理 WebSocket 连接和消息流。

- static/index.html?HTML页面。

- requirements.txt?所需依赖,通过 pip install -r requirements.txt 安装。

?

二、克隆本仓库

git clone https://github.com/AXYZdong/handy-ollama登录后复制

?

三、安装依赖

pip install -r requirements.txt登录后复制

?

四、核心代码

app.py?文件中的核心代码如下:

import ollamafrom fastapi import WebSocketasync def websocket_endpoint(websocket: WebSocket):await websocket.accept() # 接受WebSocket连接user_input = await websocket.receive_text() # 接收用户输入的文本消息stream = ollama.chat( # 使用ollama库与指定模型进行对话model='llama3.1', # 指定使用的模型为llama3.1messages=[{'role': 'user', 'content': user_input}], # 传入用户的输入消息stream=True # 启用流式传输)try:for chunk in stream: # 遍历流式传输的结果model_output = chunk['message']['content'] # 获取模型输出的内容await websocket.send_text(model_output) # 通过WebSocket发送模型输出的内容except Exception as e: # 捕获异常await websocket.send_text(f”Error: {e}“) # 通过WebSocket发送错误信息finally:await websocket.close() # 关闭WebSocket连接登录后复制

接受 WebSocket 连接:

- await websocket.accept():首先,函数接受来自客户端的 WebSocket 连接请求,建立与客户端的通信通道。

接收用户输入:

- user_input = await websocket.receive_text():通过 WebSocket 从客户端接收一条文本消息,获取用户输入的内容。

初始化对话流:

- stream = ollama.chat(...):调用 ollama 库中的 chat 方法,指定使用的模型为 llama3.1。将用户的输入作为消息传递给模型,并启用流式传输(stream=True),以便逐步获取模型生成的回复。

处理模型输出:

- for chunk in stream:遍历从模型中流式传输过来的数据块。

- model_output = chunk['message']['content']:从每个数据块中提取出模型生成的文本内容。

- await websocket.send_text(model_output):通过 WebSocket 将提取出的模型回复发送回客户端,实现实时对话。

异常处理:

- except Exception as e:如果在处理过程中出现任何异常(例如,网络问题、模型错误等),捕获异常并通过 WebSocket 发送一条错误信息,告知客户端发生了错误。

关闭 WebSocket 连接:

- finally:无论是否发生异常,最终都确保关闭 WebSocket 连接,以释放资源并结束会话。

?

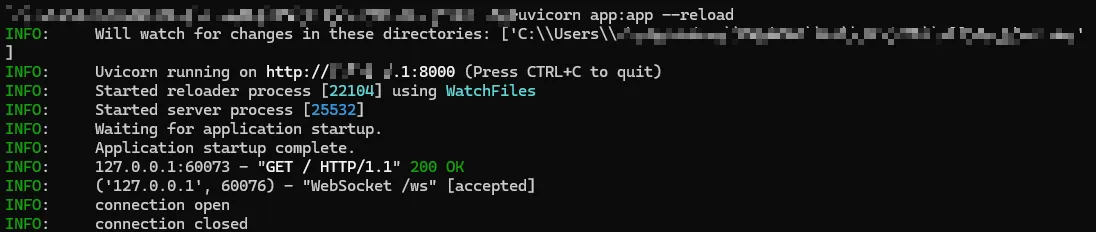

五、运行app

- 在目录下 (fastapi_chat_app/);

- 运行 app.py 文件。

uvicorn app:app --reload登录后复制

打开页面。

后台显示的正常输出。

来源:https://www.php.cn/faq/1257039.html

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- Adobe PDF编辑教程 详细步骤与实用技巧

- 时间:2026-05-27

-

- 如何查看纸条应用的登录设备记录

- 时间:2026-05-27

-

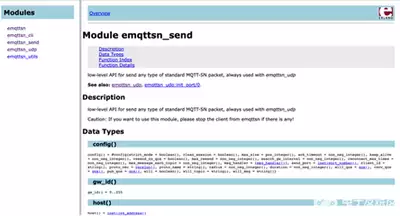

- QoderWakeAPI接口文档详解与使用指南

- 时间:2026-05-27

-

- 晶核尼尔联动武器寂曜之约强度解析与实战评测

- 时间:2026-05-27

-

- A5纸张尺寸是A4的一半吗

- 时间:2026-05-27

-

- Windows 11 最佳软件卸载工具推荐与评测

- 时间:2026-05-27

-

- 指趣游戏盒如何解绑手机号详细步骤指南

- 时间:2026-05-27

-

- 小绿鲸高亮标记取消方法详解

- 时间:2026-05-27

精选合集

更多大家都在玩

大家都在看

更多-

- 集合浆果镇哪个平台渠道福利/礼包最多最好

- 时间:2026-05-27

-

- 乐学高考课程回放观看方法详解

- 时间:2026-05-27

-

- 乐学高考App下载安装与注册登录全流程指南

- 时间:2026-05-27

-

- 该是你的跑不掉不是你的抓不住别争别抢别难过

- 时间:2026-05-27

-

- 适合早上发的干净治愈能量句子

- 时间:2026-05-27

-

- 喊他起床别温柔硬核开怼才管用

- 时间:2026-05-27

-

- 再狠心的人也顶不住你这样发朋友圈

- 时间:2026-05-27

-

- 早上起床这样发圈招财又转运

- 时间:2026-05-27