Deepseek 和Open Ai 大模型最大区别是什么

时间:2025-04-22 | 作者: | 阅读:0deepseek 和 openai 的大模型(如 gpt 系列)在技术路线、架构设计和应用场景上存在显著差异。以下是两者的主要区别:

模型架构

- DeepSeek:

- 采用 MoE(Mixture of Experts,混合专家)架构,例如 DeepSeek-V3 拥有 6710 亿参数,但在每次推理时仅激活 370 亿参数。

- MoE 架构通过动态选择专家子模型,显著降低计算量,适合高效推理。

- OpenAI(如 GPT-4):

- 使用稠密模型架构,所有参数在每次推理时都被激活。

- 虽然计算量大,但模型整体一致性强,适合通用任务。

- DeepSeek:

参数量和计算效率

- DeepSeek:

- 参数量庞大(如 DeepSeek-V3 有 6710 亿参数),但通过 MoE 架构实现高效计算,每次推理仅激活部分参数(如 370 亿)。

- 适合资源受限的场景,同时保持强大能力。

- OpenAI:

- 参数量也很大(如 GPT-4 据传有上万亿参数),但所有参数在推理时都被激活,计算成本高。

- 需要强大的硬件支持,适合对性能要求极高的场景。

- DeepSeek:

训练数据规模

- DeepSeek:

- 在 14.8 万亿 token 的数据上进行了预训练,数据规模庞大。

- OpenAI:

- GPT-4 的训练数据规模未公开,但预计也在数万亿 token 级别。

- OpenAI 的数据来源多样,包括书籍、网页、代码等。

- DeepSeek:

应用场景

- DeepSeek:

- 专注于高效推理和多任务处理,适合需要高计算效率的场景。

- MoE 架构使其在多任务学习和特定领域任务中表现优异。

- OpenAI:

- 强调通用性和多功能性,适合广泛的自然语言处理任务。

- 在对话、创作、代码生成等场景中表现突出。

- DeepSeek:

技术路线

- DeepSeek:

- 采用 MoE 架构,注重模型的可扩展性和计算效率。

- 通过动态路由机制优化资源利用。

- OpenAI:

- 采用稠密模型架构,注重模型的通用性和一致性。

- 通过大规模预训练和微调提升模型性能。

- DeepSeek:

开源与商业化

- DeepSeek:

- 目前未完全开源,更多用于特定领域或商业化场景。

- OpenAI:

- 部分模型(如 GPT-2)已开源,但最新模型(如 GPT-4)仅通过 API 提供服务,商业化程度高。

- DeepSeek:

总结

DeepSeek 和 OpenAI 的大模型各有优势,选择取决于具体需求:DeepSeek 适合高效推理和多任务处理,而 OpenAI 更适合通用任务和高性能场景。

福利游戏

相关文章

更多-

- 爆火的DeepSeek,你真的会用吗?

- 时间:2025-04-22

-

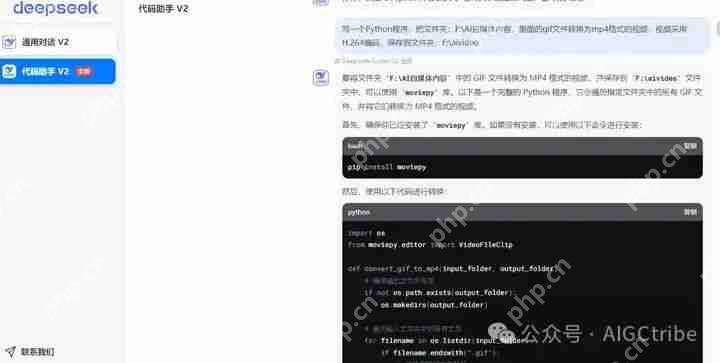

- AI办公自动化:用deepseek批量把gif动画转为mp4视频

- 时间:2025-04-22

-

- 本地部署AI大模型DeepSeek

- 时间:2025-04-22

-

- 将大局逆转吧是什么梗 抖音将大局逆转吧的意思出处解释

- 时间:2025-04-22

-

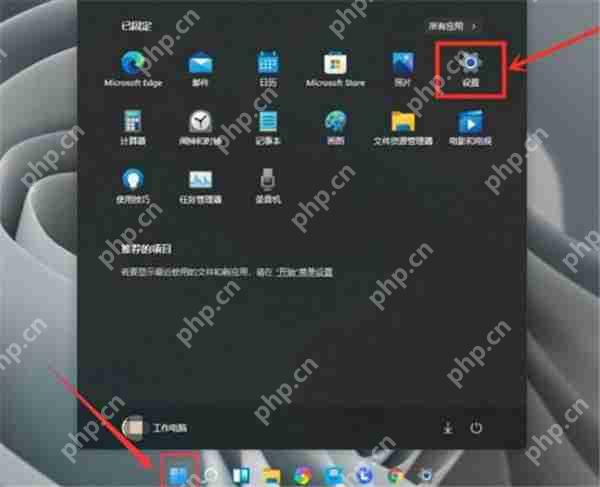

- Win11怎么添加独立显卡

- 时间:2025-04-22

-

- 那很有生活了是什么意思 网络用语那很有生活了的意思和出处介绍

- 时间:2025-04-22

-

- 惊爆!DeepSeek vs. OpenAI,基准测试对决震撼发布,谁更胜一筹?

- 时间:2025-04-22

-

- 使用腾讯 HAI 5 分钟内部署一个私人定制的 DeepSeek

- 时间:2025-04-22

精选合集

更多大家都在玩

热门话题

大家都在看

更多-

- 快查你手机有没有!67款APP违法收集使用个人信息被通报

- 时间:2025-04-22

-

- SLP币涨势分析:Axie Infinity驱动未来

- 时间:2025-04-22

-

- 联想拯救者Y9000P 2025至尊版上市:RTX 5080/5090国补价17999元起

- 时间:2025-04-22

-

- 老板拒售变质鸭躲过天花板坍塌被质疑摆拍 抖音:禁言30天

- 时间:2025-04-22

-

- 王腾用REDMI Turbo 4 Pro给咖啡机充电:一部手机能打300杯咖啡

- 时间:2025-04-22

-

- 比特币挖矿机配置:高效挖矿的关键要素

- 时间:2025-04-22

-

- Kucoin手机app使用攻略:交易、管理、赚取

- 时间:2025-04-22

-

- 剪映怎么参与国庆节活动

- 时间:2025-04-22