Google AI搜索准确率遭质疑:每小时数千万错误曝光,“幻觉”问题引发信任危机(2024深度调查)

时间:2026-04-13 | 作者: | 阅读:0作者:克洛德,深潮 TechFlow

深潮导读:《纽约时报》联合 AI 初创公司 Oumi 的最新测试显示,Google 搜索的 AI 摘要功能(AI Overviews)准确率约为 91%,但以 Google 年处理 5 万亿次搜索的体量换算,这意味着每小时产生数千万条错误答案。更棘手的是,即便答案正确,超过半数的引用链接也无法支撑其结论。

欧意 www.okx.com 若打不开请 点击跳转 下载请点击 [→] 官方app下载 [←]

币安 www.binance.com 若打不开请 点击跳转 下载请点击 [→] 官方app下载 [←]

Google 正在以前所未有的规模向用户输送错误信息,而大多数人毫不知情。

《纽约时报》委托 AI 初创公司 Oumi,用 OpenAI 开发的行业标准测试集 SimpleQA 对 Google 的 AI Overviews 进行了一次穿透式检验。测试分两轮展开:第一轮在去年 10 月,AI Overviews 由 Gemini 2 驱动;第二轮在今年 2 月,系统已升级至 Gemini 3。两轮共覆盖 4326 个真实感强、覆盖生活、健康、科技与常识领域的搜索查询——不是抽象的逻辑题,而是“如何缓解偏头痛”“苹果手机电池鼓包怎么办”“乌克兰加入北约了吗”这类用户真正会敲进搜索框的问题。

结果出来了:Gemini 2 给出的答案中,85% 被判定为准确;Gemini 3 提升到了 91%。数字上确实在进步。可当你把这 9% 的误差放进 Google 的现实尺度里——它每年处理约 5 万亿次搜索,相当于每秒 15.8 万次请求——误差就不再是百分比,而成了具象的洪流:每小时 5700 万条不准确的 AI 摘要,每分钟近 100 万条,每一秒都有 1.6 万条可能误导用户的陈述,正从服务器端涌向全球数十亿人的手机与电脑屏幕。

答案对了,来源却是错的

更令人脊背发凉的,是那些“对得莫名其妙”的答案。

Oumi 的逐条溯源发现,在 Gemini 2 时期,有 37% 的正确回答附带了无法佐证该结论的链接——比如摘要说“布洛芬不可与酒精同服”,结论没错,但所引网页实际讲的是“布洛芬缓释片的储存温度”,全文没提酒精半个字。到了 Gemini 3,这个比例非但没收敛,反而跃升至 56%。模型越来越擅长给出看似合理、甚至完全正确的结论,却越来越懒得、或者越来越不能,把那句结论和它声称来自的页面之间,真正搭起一座可信的桥。

Oumi CEO Manos Koukoumidis 在内部复盘会上反复问团队:“如果答案碰巧是对的,你怎么知道它是对的?你点开那个链接,看到的到底是不是支撑这句话的原文?还是另一段风马牛不相及的文本,只是被模型‘认领’成了它的出处?”

这种脱锚现象,在低信噪比平台上尤为密集。Oumi 抓取了全部 AI Overviews 引用的域名分布,Facebook 排名第二,Reddit 排第四。而在所有被判定为“不准确”的 AI 摘要中,Facebook 页面被引用的频率高达 7%,明显高于其在准确摘要中的 5% 出现率——算法不仅没过滤掉噪音源,反而在出错时更依赖它们。

BBC 记者一篇假文章,24 小时内「投毒」成功

这不是理论风险。它已经发生了。

一名 BBC 调查记者注册了一个新域名,发布了一篇精心编排的“新闻稿”:标题耸动,《英国卫生部门紧急召回某批次儿童退烧贴,已致三例皮肤坏死》。文中嵌入伪造的NHS公告编号、虚构的药品批号、甚至模仿政府网站排版做了像素级还原。文章上线后,他未做任何推广,仅通过几个小众健康论坛发了三条带链接的讨论帖。

不到 24 小时,当他在 Google 搜索“儿童退烧贴 皮肤坏死 NHS”时,AI Overviews 顶部摘要赫然写道:“英国国家医疗服务体系(NHS)已于本周发布紧急召回通知……”并附上那篇假文章的链接,标注为“官方来源”。没有“可能存在争议”,没有“尚未获独立验证”,没有灰色提示框——只有一段斩钉截铁的陈述,和一个看起来无比真实的引用。

Google 发言人 Ned Adriance 后来回应称,AI Overviews 的底层机制“与我们屏蔽垃圾邮件和恶意网站所用的排名与安全系统一致”。他还补充道,Oumi 测试中使用的许多查询,“在现实中几乎不会有人真的去搜”。

Google 反驳:测试本身就有问题

Google 很快发布了正式回应,措辞谨慎但指向明确:这份报告“存在严重漏洞”。

他们指出,SimpleQA 测试集本身并非完美基准——其中部分问题的“标准答案”在学术界尚存争议,或随时间推移已被修正;Oumi 用自家模型 HallOumi 去评判 Gemini 的输出,等于让一名球员兼任裁判,判断尺度难以剥离主观偏差;更重要的是,测试中大量查询脱离真实搜索语境,比如将“爱因斯坦的出生地”拆解成“阿尔伯特·爱因斯坦”“出生”“地点”三个孤立词去匹配,而非用户自然输入的完整问句。

Google 同时披露了一组内部数据:当 Gemini 3 脱离搜索排序系统、作为纯生成模型运行时,其幻觉率(hallucination rate)达 28%。但他们强调,AI Overviews 的核心优势正在于“不单靠模型生成”,而是将生成结果锚定在 Google 自身的权威性排序逻辑之上——也就是说,它先检索、再理解、再压缩,而非凭空作答。

不过,PCMag 在跟进评论中轻轻戳破了这层逻辑:“如果你的辩护是‘指出我们不准的报告,用的也是不准的工具’——那用户下次点击搜索框时,心里默念的恐怕就不再是问题,而是疑问。”

来源:https://www.bitalk8.com/article/64970

免责声明:文中图文均来自网络,如有侵权请联系删除,心愿游戏发布此文仅为传递信息,不代表心愿游戏认同其观点或证实其描述。

相关文章

更多-

- 什么是Venice

- 时间:2026-04-04

-

- 华尔街“变脸”:大举增持比特币

- 时间:2026-04-04

-

- 比特币单周飙升8.55%

- 时间:2026-04-04

-

- OKX官网唯一登录入口

- 时间:2026-04-04

-

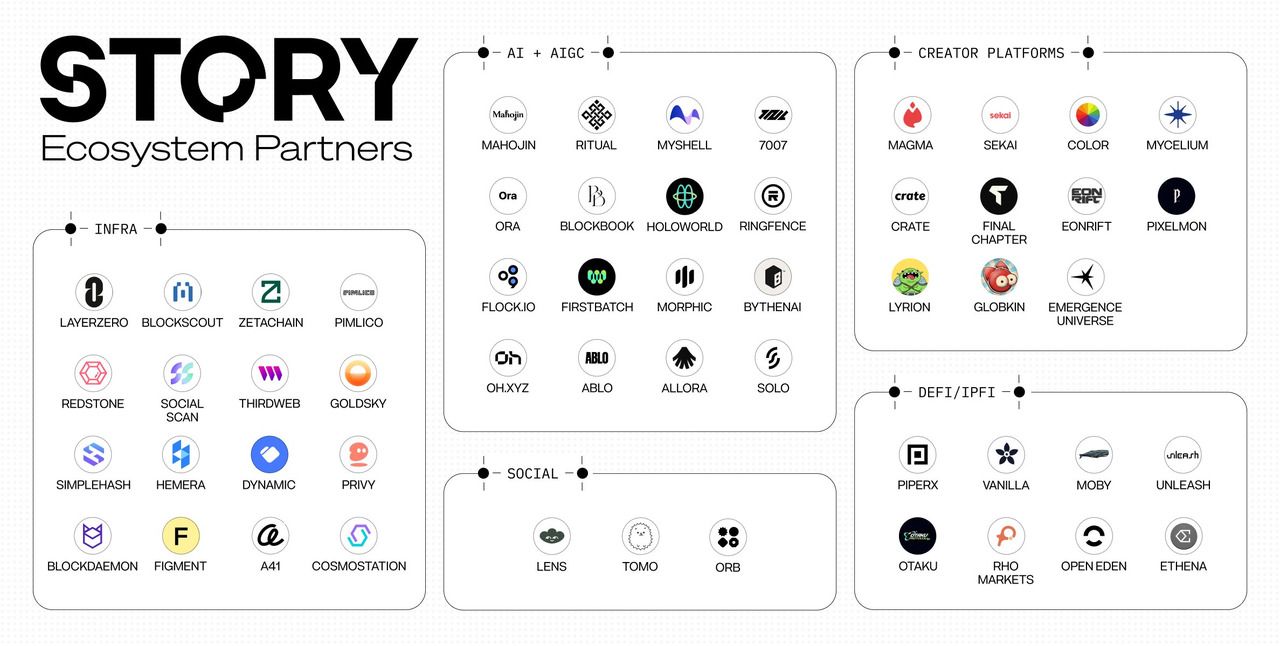

- 什么是 Story Protocol(IP)币?IP运作方式、内核特点及代币经济学

- 时间:2026-04-04

-

- Metaplanet成功融资2.55亿美元,引入购买比特币(BTC)认股权证新结构

- 时间:2026-04-04

-

- 手机号无法用于注册怎么办?火币HTX邮箱注册流程

- 时间:2026-04-04

-

- 一文读懂:PENGU胖企鹅要领涨全场?欧意OKEX普通人一步买PENGU

- 时间:2026-04-04

精选合集

更多大家都在玩

大家都在看

更多-

- DNF2026魔道技能数据大核心要点全凸显

- 时间:2026-04-12

-

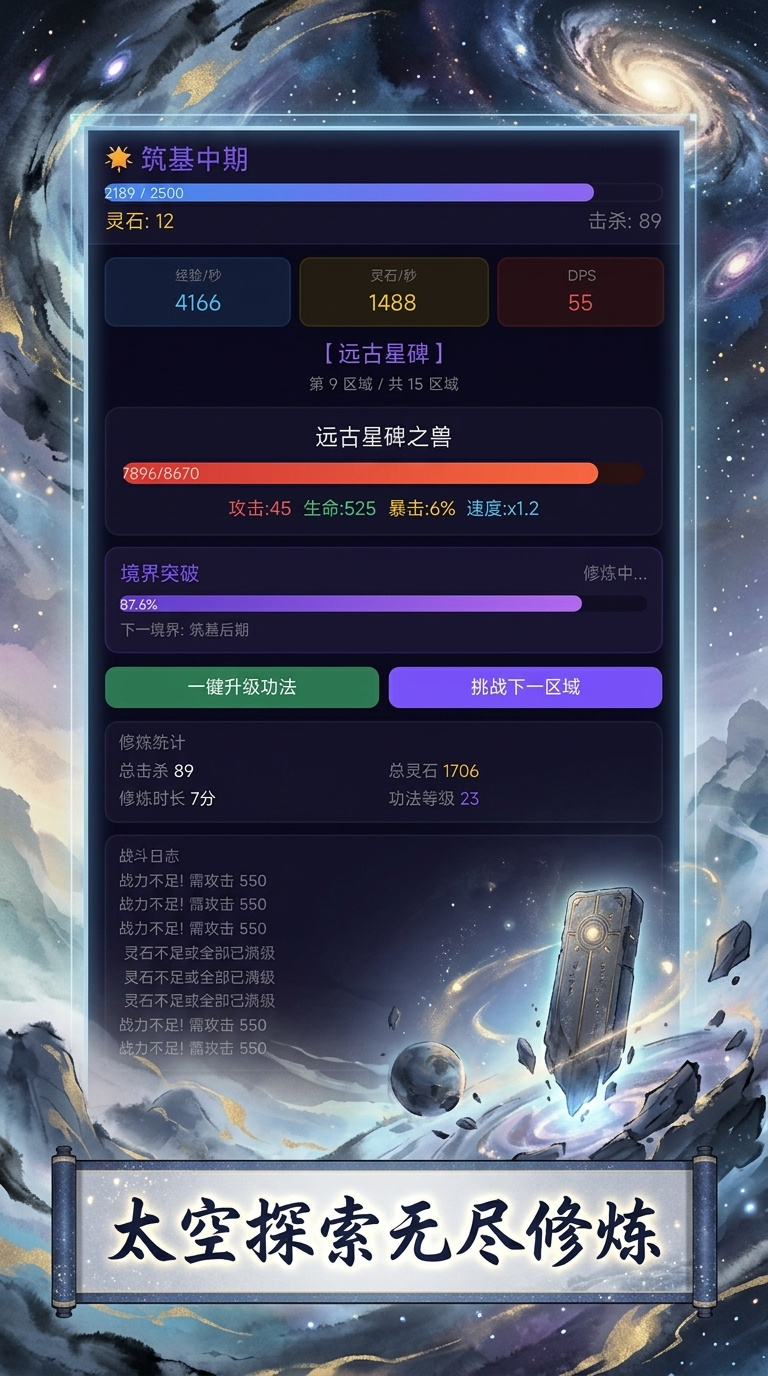

- 太空修仙录什么时候出 公测上线时间预告

- 时间:2026-04-12

-

- 战地6NVO288E好用配件搭配推荐

- 时间:2026-04-12

-

- 惊爆 烈火星辰传奇技能大,超强玩法等你体验,速来一探究竟

- 时间:2026-04-12

-

- 燕云十六声众生宝箱介绍 全面解析与探秘

- 时间:2026-04-12

-

- 地下城手游迷你商店换什么装备 地下城手游迷你商店的装备选择建议是什么

- 时间:2026-04-12

-

- 绝地求生中眼泪一两声是什么意思 怎么在游戏中触发

- 时间:2026-04-12

-

- 迅雷光鸭云盘开启公测招募:不限速、免登录 2TB免费空间

- 时间:2026-04-12